KI für die Erstellung von Videos aus mehreren Bildern

Laden Sie 3 Keyframe-Bilder hoch, um automatisch ein flüssiges und zusammenhängendes One-Shot-Video zu generieren. Lösen Sie das Problem von Frame-Skipping und Brüchen bei der Übertragung von KI-Videos und erzielen Sie professionelle Effekte mit räumlicher Kontinuität und natürlichen Kamerafahrten.

Bewertungen & Kommentare

Noch nicht genügend Bewertungen oder Rezensionen erhalten

SeaArt Mehrere Bilder zu Video KI Kostenlos Online

Erstelle KI-konsistente Videos aus mehreren Frames mit SeaArt Multiple Images to Video AI kostenlos. Lade 3 Bilder in einer Sequenz hoch und generiere dynamische KI-Videos mit flüssigen Übergängen zwischen den Bildern.

Nahtloses Verschmelzen mehrerer Bilder zu dynamischen Videos

Lade 3 Bilder hoch, um räumlich kontinuierliche, filmisch flüssige One-Take-Videos mit SeaArt Multiple Images to Video AI zu erstellen. Es bewahrt Charakteridentität, Stil und Szenenlogik. SeaArts Multi-Bild-Konditionierung geht über Standard Bild-zu-Video-KI hinaus, indem es Posen, Ausdrücke und Layout mit deinem Prompt abstimmt und flüssige Bewegungen und konsistente Visuals über jeden Frame hinweg erzeugt.

Überlegene visuelle Kontinuität über mehrere Frames

Erreiche außergewöhnliche visuelle Stabilität und Charakterbewahrung mit SeaArt Multiple Images to Video AI. Es erkennt automatisch deine Bilder, erfasst Gesichtsmerkmale, Kleidungsdetails und Umgebungselemente, um eine nahtlose Identitätsbeibehaltung beim Übergang zwischen Szenen oder Kamerawinkeln zu gewährleisten. Dieses Tool kann lange Aufnahmen für 15 Sekunden mit atemberaubender Bewegungsdynamik, zeitlicher Taktung und Videoeffekten generieren.

Verstärke deine Projekte mit Multi-Bild-Videogenerierung

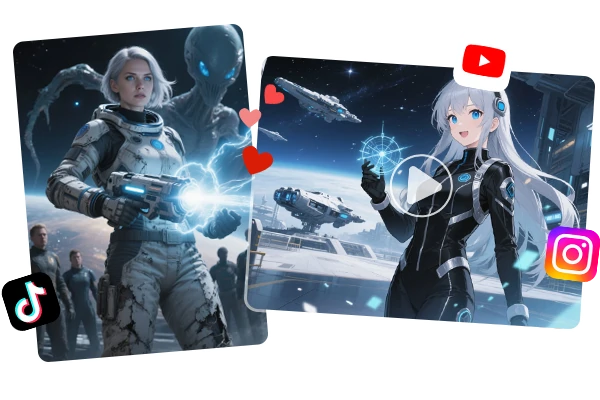

Nutze Mehrere Bilder zu Video KI, um deine KI-Videoerstellung effektiver und kostengünstiger zu gestalten. Du kannst Kanal-Maskottchen animieren, Storyboards zu Kurzfilmen zusammenfügen und visuelle Kontinuität in Social-Media-Clips und Werbung bewahren. Pädagogen können Konzepte mit wiederkehrenden Charakteren illustrieren; Marken können Kampagnen mit modellgerechten Helden prototypisieren; unabhängige Kreative können Szenen mit begrenztem Budget visualisieren – während stilistische und Charakterkonsistenz erhalten bleiben.

Nahtlose Langaufnahmen-Generierung

Erstelle kontinuierliche, ununterbrochene Videosequenzen durch intelligente Keyframe-Analyse, die abrupte Schnitte eliminiert und räumliche Kohärenz während ausgedehnter Szenen aufrechterhält.

Intelligente Bilderkennung

Analysiert automatisch hochgeladene Keyframe-Bilder, um räumliche Beziehungen, Charakterpositionierung und Umgebungskontext zu verstehen, was eine natürliche Progression gewährleistet und visuelle Konsistenz über die gesamte Videosequenz hinweg aufrechterhält.

Konsistente Videoausgabe

Behält einheitlichen Rhythmus, natürlichen Fluss und räumliche Kontinuität über alle generierten Inhalte hinweg bei und eliminiert häufige KI-Video-Probleme wie Frame-Sprünge, Inhaltsunterbrechungen und inkonsistente Bewegungsmuster.

Wie verwendet man Mehrere Bilder zu Video KI?

Schritt 1: Lade deine Bilder hoch

Wähle 3 klare, relevante Bilder aus, die zu deinem KI-generierten Video zusammengeführt werden sollen. Das System funktioniert optimal mit frontalen und Profilansichten für umfassendes Charakter-Mapping.

Schritt 2: Gib die Eingabeaufforderungen ein

Gib eine detaillierte Beschreibung des Videos ein, das du generieren möchtest, und wie deine Objekte miteinander interagieren.

Schritt 3: Generieren und herunterladen

Klicke auf die Schaltfläche "Generieren" und warte einige Sekunden. Lade das Video herunter und teile es nach Belieben!

SeaArt Mehrere Bilder zu Video KI - FAQs

Was ist die Mehrere Bilder zu Video KI-Technologie?

Mehrere Bilder zu Video KI repräsentiert ein fortschrittliches Generierungssystem, das Videoinhalte aus 2-4 Referenzbildern synthetisiert und dabei visuelle Konsistenz bewahrt. Die Technologie analysiert Gesichtsgeometrie, Posenstrukturen und Umgebungskontext über Quellmaterialien hinweg, um kohärente animierte Sequenzen mit natürlichem Bewegungsfluss und bewahrter Charakteridentität zu erzeugen.

Wie unterscheidet sich Multi-Bild-Video von traditioneller Bild-zu-Video-Konvertierung?

Traditionelle Bild-zu-Video-Tools animieren einzelne statische Fotografien durch Bewegungsvorhersage, was oft zu inkonsistenten Details und Identitätsdrift führt. Multi-Bild-Technologie nutzt mehrere visuelle Referenzen, um ein robustes Charakterverständnis zu etablieren, was stabile Animation über verschiedene Posen, Lichtbedingungen und Kamerawinkel hinweg ermöglicht, während überlegene visuelle Wiedergabetreue erhalten bleibt.

Kann ich spezifische Aspekte wie Kamerabewegung und Charakteraktionen steuern?

Ja, SeaArts System unterstützt detailliertes Prompt-Engineering für präzise kreative Kontrolle. Benutzer können Kameratrajektorien, Zoomeffekte, Charaktergesten, Gesichtsausdrücke und Umgebungsinteraktionen spezifizieren. Fortgeschrittene Parameter umfassen Bewegungsgeschwindigkeitsanpassung, Übergangszeiten und Referenzbildpriorisierung für angepasste Ergebnisse.

Was sind die optimalen Bildanforderungen für beste Ergebnisse?

Für maximale Qualität verwende hochauflösende Bilder (mindestens 1024x1024) mit konsistenter Beleuchtung, klaren Gesichtsdetails und minimaler Bewegungsunschärfe. Füge verschiedene Winkel (Front, Profil, Dreiviertel) desselben Motivs ein, behalte ähnliches Farbgrading über Quellen hinweg bei und stelle sicher, dass Motive für eine genaue Analyse signifikante Teile des Bildausschnitts einnehmen.