English

Analysis Report on Strengthened Moderation and False Detection Issues in the SeaArt Platform

1. Introduction

Recently, the SeaArt platform has implemented a reinforced AI-based automatic moderation system, aiming to improve content management efficiency while adhering to global regulatory standards.

However, this policy change has unintentionally resulted in side effects, with a rising number of false positives in legitimate artworks and a noticeable imbalance in moderation sensitivity between genders and tag contexts.

This report analyzes the background, causes, and inconsistencies of the strengthened moderation system on SeaArt, and proposes technical and policy improvements to ensure fair and operation of the platform.

2. Current Situation

2-1. Structural Issues in the Automated Moderation System

To prevent the spread of or adult AI-generated content, SeaArt has recently overhauled its AI-driven automatic moderation algorithm.

The system uses both image-recognition and text-based keyword filtering; however, the following issues have emerged:

- Increase in False Positives Non-s-ex-ual or non- artworks are being misclassified as “” due to certain color tones, body poses, or keyword combinations. For example, a neutral term like “ shoulder” may trigger moderation, causing even normal illustrations to be blurred.

- Persistent Blur and Hidden Content Images are often automatically blurred immediately after posting, and even after an appeal is approved, unblurring is delayed or fails to take effect. This behavior is likely caused by synchronization delays or unprocessed moderation signals, resulting in significant user frustration.

- Instability in Keyword Lists and Multilingual Bugs Since the moderation word database is managed in multiple languages, translation mismatches and duplicated entries have caused unintended keyword blocks. Some non-s-ex-ual terms have been incorrectly strengthened, activating unnecessary censorship triggers.

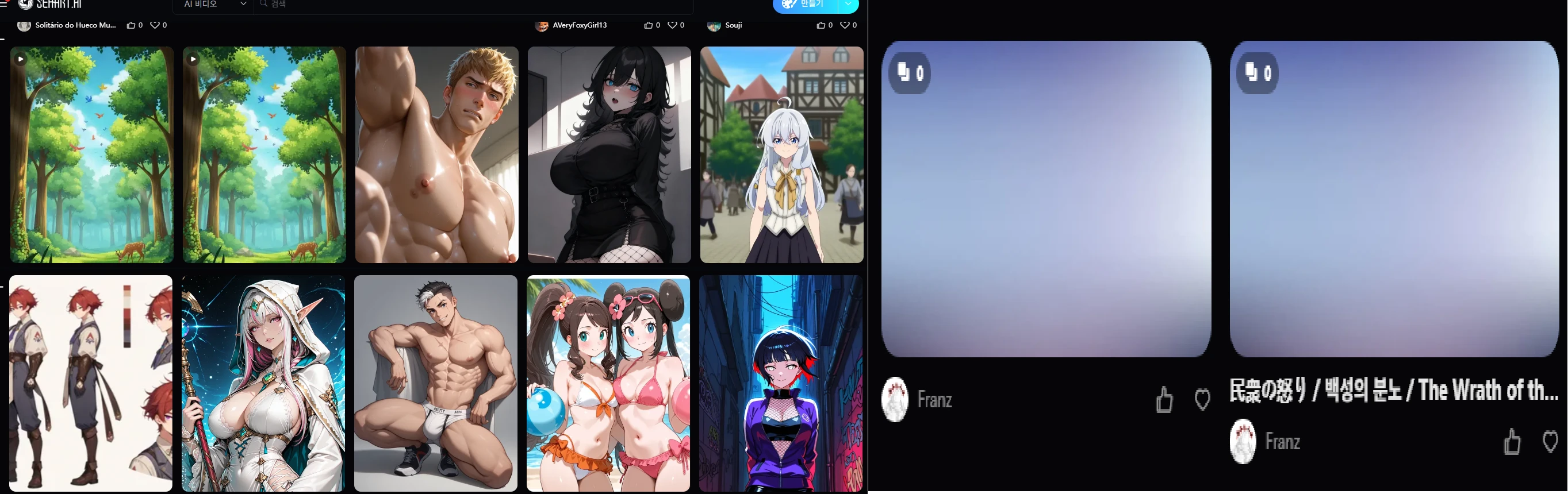

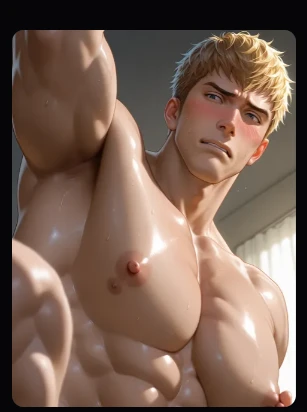

2-2. Imbalance in Moderation of Male Illustrations

Recent reports indicate that male illustrations that are entirely normal and non- are being restricted due to system bugs, while at the same time, highly se-xu-alized or male images bypass the moderation filter and are displayed publicly without restriction.

This suggests that the AI moderation algorithm behaves inconsistently depending on gender context or tag combinations.

In particular, male characters featuring muscular physiques or partial exposure are often misclassified as “,” whereas more overtly images are approved without issue, revealing a clear lack of policy consistency.

This imbalance can be clearly demonstrated through the following examples.

[Comparison Example]

Prompt 1 – Restricted (Non- Example)

(masterpiece, best quality), luxury great hall, medieval,

1boy , solo , adult , (male) , handsome face , cowboy shot , silver ponytail , fair skin , serious , enraged , fury , blazing eyes tightly , teeth, yellow-olive noble clothes , military uniform, standing ,

Prompt 2 – Allowed ( Example)

asuma sensei, handsome,Men only,stupid,bulto,low angle,squat,again,gordos y gruesos,massive pectoral muscles, fat , large areoles ,prominent , play, movement, pinch,very detailed skin Blush,shy,mental break,intricate details,hyperrealistic,ultra detailed,shadows,RM, expression, shimmering sweat ,up-close view, studio environment ,dramatic pose,photorealistic,8K,HDR-10,rendered based on 8th physics

When comparing the two prompts, it becomes evident that Prompt 2 contains far more and ?ly suggestive expressions than Prompt 1.

However, in practice, Prompt 1 was restricted while Prompt 2 remained publicly visible, demonstrating that the current SeaArt moderation system relies primarily on keyword-based detection rather than contextual evaluation.

Such inconsistency causes users to perceive the moderation standards as opaque and unfair, ultimately leading to a decline in overall trust toward the platform’s content management system.

3. Cause Analysis

(1) Overfitting of the AI Moderation Model

The AI model has been over-trained to react sensitively to specific forms, colors, and tag patterns, causing it to penalize unintentional visual elements.

This has blurred the line between “artistic depiction” and “ expression,” leading to overly conservative classification tendencies.

(2) Global Regulatory Pressure

Between 2024 and 2025, major AI platforms have strengthened their automatic regulation of adult or .

SeaArt followed this global trend, but its direct adoption of such standards resulted in rigid, one-size-fits-all moderation that fails to account for cultural and artistic diversity.

(3) Keyword Database and Synchronization Errors

During multilingual updates, the merging and translation of keyword lists caused duplication and keyword conflicts, producing filtering overloads.

Certain words were blocked without considering context, causing the moderation engine to behave unpredictably.

4. Identified Problems

- Restriction of Creative Expression Artistic or narrative depictions of the human form are often misinterpreted as , discouraging creativity.

- Inefficiency and Distrust in the Appeal System Even after successful appeals, unblurring delays persist, leading to skepticism about the reliability of the moderation system itself.

- Gender and Tag Bias in Moderation The same degree of exposure or expression is treated differently based on gender, reinforcing perceptions of unfairness within the community.

- Decline in Community Engagement and Content Diversity Repeated false positives reduce creator motivation, gradually lowering both content variety and artistic quality across the platform.

5. Recommendations and Improvement Strategies

(1) Enhance AI Model Precision

- Introduce context-aware multi-layer moderation models capable of distinguishing artistic from .

- Expand the training dataset to include diverse cultural and artistic representations.

(2) Increase Transparency of Moderation Standards

- Publicly disclose portions of the moderation keyword list and decision criteria to give users clear guidance.

- Strengthen the efficiency of the existing community-based “Filter Feedback Loop System”, ensuring that user reports and false-positive feedback are regularly integrated into model retraining and system updates.

- Formalize a continuous process of Feedback → Verification → Model Update, enhancing transparency and user trust.

(3) Stabilize Appeal and Synchronization Systems

- Improve server cache and moderation-status synchronization to ensure real-time reflection of appeal results.

- Prevent residual blur states and redundant re-moderation after unblurring.

(4) Balance Moderation Across Gender and Cultural Contexts

- Calibrate the AI model for gender-neutral evaluation, applying identical criteria to both male and female representations.

- Shift from exposure-based judgment to context-based moderation, focusing on artistic intent and narrative framing.

6. Conclusion

The strengthened moderation system on SeaArt reflects the broader global effort to regulate AI-generated content.

However, current implementation issues — including technical false positives, policy inconsistency, and lack of transparency — risk leading to a decline in creative freedom and user trust.

To ensure long-term stability and fairness, SeaArt must act on three strategic priorities:

- Refine and validate its AI moderation models.

- Increase transparency and strengthen community-based collaboration.

- Stabilize technical infrastructure for real-time updates and appeals.

By pursuing these improvements, SeaArt can evolve beyond a simple content-sharing platform to become a global creative hub that safeguards both artistic freedom and responsible AI governance.

Personal Opinion

The most significant issue with the current moderation system lies in its lack of clear and consistent standards. Some content is approved while other, nearly identical works are restricted, and users are given no clear information about the reasons behind such decisions.

In this restricted environment, creators experience a sense of loss and helplessness due to seemingly unfair censorship, and some express strong frustration toward these opaque measures. This is not merely an emotional reaction — it reflects a structural mistrust in an environment where freedom of expression and creative rights are not adequately protected.

While it is understandable that the platform, as a company, must enforce certain regulations to fulfill its legal and ethical responsibilities, it is equally essential to provide a system that allows creators to identify and understand the cause of moderation so that they can improve their content accordingly.

Therefore, when moderation or content restriction occurs, there must be a feedback interface or review system through which creators can clearly verify the reasons — whether related to an illustration, video, or text and tags within a post.

Such a system would not only resolve user dissatisfaction but would also strengthen overall trust in the platform and foster a healthy and sustainable creative ecosystem.

Japanese

SeaArtプラットフォームにおける検閲強化および誤判定問題に関する分析報告書

1. 序論

近年、SeaArtプラットフォームはAI自動検閲フィルタリングシステムの強化政策を導入し、コンテンツ管理の効率化と国際的な規制基準の遵守を同時に目指している。

しかし、この取り組みにより、副作用として正当な作品が誤って検閲対象となる誤判定(False Positive)や、性別・タグ構成による検閲の不均衡が多数報告されている。

本報告書は、SeaArtにおける検閲強化の背景・原因・問題点を技術的および政策的観点から分析し、今後の公平で透明な運用に向けた改善提案を示すものである。

2. 現状

2-1. 自動検閲システムの構造的問題

SeaArtは、AI生成による不適切またはの拡散を防ぐ目的で、AIベースの自動検閲アルゴリズムを全面的に改修した。

本システムは、画像解析とテキストベースのキーワード検出を組み合わせて動作しているが、以下の問題点が明らかとなっている。

- 誤判定の増加 非アダルト・非性的な内容であるにもかかわらず、特定の色調やポーズ、キーワードの組み合わせによって「」と誤認される事例が多数発生。 例として、“ shoulder(肩が見える)”のような一般的な表現でも過剰に検出され、通常の人物イラストまでもがブラー処理されてしまうことがある。

- ブラー処理および非公開状態の持続 投稿直後に自動的にブラー処理が施され、アピール(異議申し立て)が承認されても、解除が反映されないケースが頻発。 サーバー同期の遅延や検閲解除信号の未処理が原因とみられ、ユーザー体験に深刻な不便をもたらしている。

- 検閲ワードリストの不?性および多言語バグ フィルタリング基準が多言語で管理されているため、翻訳の不一致や重複登録により意図しない単語が検出トリガーとなっている。 一部の単語が過剰に強化され、非性的な文脈においても検閲が発動することが確認されている。

2-2. 男性イラストにおける検閲の不均衡

最近の報告によると、まったく健全で非性的な男性イラストがバグによって投稿制限を受ける一方で、極めて性的または露骨な男性イラストがフィルタをすり抜けて公開されている事例が確認されている。

このことは、AI検閲アルゴリズムが性別やタグの組み合わせによって一貫性のない挙動を示していることを示唆している。

特に、筋肉表現や部分的な露出を含む男性キャラクターが「」と誤認される一方で、より露骨な内容の画像が問題なく通過するなど、方針の整合性に欠ける状況が発生している。

この不均衡は、以下の例から明確に確認することができる。

【比較例】

プロンプト1 — 制限対象(非性的な例)

(masterpiece, best quality), luxury great hall, medieval,

1boy , solo , adult , (male) , handsome face , cowboy shot , silver ponytail , fair skin , serious , enraged , fury , blazing eyes tightly , teeth, yellow-olive noble clothes , military uniform, standing ,

プロンプト2 — 通過(露骨な例)

asuma sensei, handsome,Men only,stupid,bulto,low angle,squat,again,gordos y gruesos,massive pectoral muscles, fat , large areoles ,prominent , play, movement, pinch,very detailed skin Blush,shy,mental break,intricate details,hyperrealistic,ultra detailed,shadows,RM, expression, shimmering sweat ,up-close view, studio environment ,dramatic pose,photorealistic,8K,HDR-10,rendered based on 8th physics

この2つのプロンプトを比較すると、プロンプト2の方がはるかに性的で露骨な表現を多数含んでいることが明らかである。

しかし実際には、プロンプト1が制限され、プロンプト2がそのまま公開された事例が確認されており、SeaArtの現行検閲システムが文脈や表現意図ではなく、主にキーワード検出に依存していることを示している。

このような不整合は、ユーザーに検閲基準の不透明さと不公平さを認識させ、最終的にはプラットフォーム全体の信頼性低下につながっている。

3. 原因分析

(1) AIモデルの過学習(オーバーフィッティング)

AIモデルが特定の形状・色・タグパターンに過敏に反応するよう訓練されており、意図しない表現まで検出・制限している。

これにより、「芸術的表現」と「性的表現」の境界が曖昧になり、システム全体が過度に保守的な判断傾向を示している。

(2) 国際的なAIコンテンツ規制の影響

2024〜2025年にかけて、主要なAIプラットフォームが性的画像・の自動規制を強化している。

SeaArtもこの世界的な流れに沿って対策を導入したが、国際基準をそのまま適用した結果、文化的・芸術的多様性を考慮しない画一的な規制となっている。

(3) 検閲ワードデータベースの管理および同期エラー

多言語更新の過程で、キーワードリストの統合や翻訳において重複・競合エラーが発生。

文脈を無視して単語がブロックリストに登録されるなど、結果的にフィルタリングの暴走を引き起こしている。

4. 問題点

- 創作表現の自由の制限 芸術的・物語的文脈での人体描写までもが性的と誤認され、クリエイターの創造性を抑制している。

- アピールシステムの非効率と不信感の拡大 アピールが承認されても解除が反映されない遅延が続き、システムの信頼性に疑問が生じている。

- 性別・タグ別の検閲不均衡 同程度の露出や構図であっても、性別によって検閲強度が異なるため、不公平な印象を与えている。

- コミュニティ活性度と作品多様性の低下 誤判定の繰り返しによりユーザーの投稿意欲が減少し、SeaArt内の作品バリエーションや品質が低下している。

5. 改善提案

(1) AIフィルタリングモデルの精度向上

- 芸術的・非芸術的コンテンツを区別できる文脈認識型マルチレイヤーモデルの導入。

- 学習データにおいて文化的多様性および芸術表現を十分に反映させること。

(2) 検閲基準の透明性向上

- 検閲ワードリストおよび判定基準の一部を公開し、ユーザーに明確なガイドラインを提供する。

- すでに実施中のコミュニティ主導「フィルタ・フィードバック・ループ・システム」の運用効率を強化し、 ユーザーの誤判定報告や意見が定期的にAIモデルの改善へ反映される仕組みを確立する。

- 「フィードバック → 検証 → モデル更新」の循環プロセスを制度化し、透明性と信頼性を高める。

(3) アピールおよびサーバー同期システムの?化

- アピール結果をリアルタイムに反映できるよう、キャッシュおよび検閲状態の同期プロセスを改善。

- ブラー解除後に再び検閲される再発現象を防止する技術的対策が必要。

(4) 性別・文化的バランスを考慮した検閲方針の確立

- 男女いずれのキャラクターにも同一の判定基準を適用するよう、AIモデルのジェンダーニュートラル化を推進。

- 単純な露出量ではなく、文脈・意図を重視したモデレーション(Context-based Moderation)へ移行する。

6. 結論

SeaArtプラットフォームの検閲強化は、AI生成コンテンツ規制の世界的な潮流の中で避けがたい措置といえる。

しかし現状では、技術的誤判定・政策的不均衡・透明性の欠如といった複合的問題が存在し、長期的には創作活動の萎縮とユーザー信頼の低下を招く恐れがある。

今後、SeaArtが持続的かつ公正な運用を実現するためには、次の3つの重点方針を早急に実行すべきである。

- AI検閲モデルの高度化と検証体制の確立

- 検閲方針の公開およびコミュニティ協働の強化

- リアルタイム反映を可能にする技術的インフラの?化

これらの改善が実現すれば、SeaArtは単なるコンテンツ共有プラットフォームを超え、

AI時代における創作の自由と責任を両立させる、世界的なクリエイティブハブへと発展できるだろう。

個人的な意見

現在のモデレーションシステムにおける最大の問題は、判定基準の不明確さと一貫性の欠如にある。 あるコンテンツは通過する一方で、ほぼ同等の内容が制限されるケースが繰り返されており、 その理由についてユーザーが明確に把握できる情報がまったく提供されていない点が根本的な課題である。

このように表現の自由が制限された環境下で、クリエイターは不当な検閲に対する喪失感や無力感を感じ、一部のユーザーはこの不透明な制裁に強い不満を表明している。 これは単なる感情的な反応ではなく、表現の自由と創作の権利が十分に守られていない環境に対する構造的な不信感の表れである。

もちろん、プラットフォームが企業として法的・倫理的責任を果たすために一定の規制を設けることは理解できる。 しかし同時に、クリエイターが自ら問題点を把握し、改善できるよう支援する仕組みを整備することが不可欠である。

したがって、検閲や制限が行われた場合には、 イラスト・動画・投稿文・タグなど各要素ごとに具体的な理由を確認できる透明なフィードバックインターフェースまたは結果確認システムを構築すべきである。

このような仕組みは、単にクリエイターの不満を解消するだけでなく、プラットフォーム全体の信頼性向上と健全な創作エコシステムの形成にも大きく寄与するだろう。

Korean

SeaArt 플랫폼 검열 강화 현황 및 오탐지 문제에 대한 분석 보고서

1. 서론

최근 SeaArt 플랫폼은 AI 자동 검열 필터링 시스템의 강화 정책을 시행하며, 콘텐츠 관리의 효율성과 국제적 규제 기준 준수를 동시에 추구하고 있다.

그러나 이러한 시스템 강화는 일부 부작용을 초래하며, 정상적인 예술 창작물에 대한 오탐지(誤探知) 및 성별·태그별 검열 불균형 현상이 다수 보고되고 있다.

본 보고서는 SeaArt의 검열 시스템이 강화된 배경과 그에 따른 기술적 문제, 그리고 정책적 불균형을 종합적으로 분석하여 플랫폼 운영의 개선 방향을 제시하는 것을 목적으로 한다.

2. 현황

2-1. 자동 검열 강화 및 필터링 시스템의 구조적 문제

SeaArt는 플랫폼 내 불-법적· AI 생 확산을 방지하기 위해, AI 기반의 자동 검열 알고리즘을 전면 개편하였다. 이 시스템은 이미지 분석 및 텍스트 기반 키워드 필터링을 복합적으로 적용하는 방식으로 작동하나, 다음과 같은 문제점이 드러나고 있다.

- AI 필터링의 오탐지 빈도 급증 : 비성인·비 콘텐츠임에도 불구하고, 특정 색조나 인체 포즈, 키워드 조합만으로 ‘’로 분류되는 사례가 다수 확인되었다. 예를 들어 ‘ shoulder’와 같은 일반적 묘사조차 과도하게 검열되어, 정상적인 인물 일러스트까지 블러 처리되는 상황이 발생한다.

2. 게시물 블러 처리 및 비공개화 지속 현상 : 이미지 게시 직후 자동 블러가 적용되고, 항소(Appeal) 절차를 거친 후에도 검열 해제가 정기적으로 반영되지 않는 사례가 빈번하다. 이는 서버 동기화 지연 또는 검열 해제 신호의 반영 오류로 추정되며, 사용자 경험에 심각한 불편을 초래한다.

3. 검열 단어 리스트의 불안정성과 번역 기반 버그 발생 : 필터링 기준에 사용되는 키워드 데이터베이스가 다국어 기반으로 관리되면서, 번역 불일치 및 데이터 중복으로 인한 의도치 않은 단어 차단이 발생한다. 일부 키워드는 불필요하게 강화되어, 비 맥락에서도 차단 트리거로 작동하는 것으로 확인된다.

2-2. 남성 일러스트 검열 불균형 문제

최근 보고에 따르면, 정상적으로 출력된 남성 일러스트조차 버그로 인해 게시가 제한되는 사례가 증가하고 있다.

동시에, 명백히 성적이거나 노골적인 남성 일러스트가 필터링을 우회하여 정상적으로 되는 현상도 다수 확인되었다.

이는 AI 검열 알고리즘이 성별이나 태그 조합에 따라 다르게 작동하고 있음을 시사한다.

특히, 남성 캐릭터의 근육 표현이나 신체 이 포함된 경우 “”로 오인되어 제재되는 반면, 더 노골적인 이미지는 정상 통과되는 등 정책적 일관성의 결여가 발생하고 있다.

이러한 불균형은 다음 예시를 통해 명확히 드러난다.

[비교 예시]

1번 이미지 프롬프트 (제한된 사례)

(masterpiece, best quality), luxury great hall, medieval,

1boy , solo , adult , (male) , handsome face , cowboy shot , silver ponytail , fair skin , serious , enraged , fury , blazing eyes tightly , teeth, yellow-olive noble clothes , military uniform, standing ,

2번 이미지 프롬프트 (된 사례)

asuma sensei, handsome,Men only,stupid,bulto,low angle,squat,again,gordos y gruesos,massive pectoral muscles, fat , large areoles ,prominent , play, movement, pinch,very detailed skin Blush,shy,mental break,intricate details,hyperrealistic,ultra detailed,shadows,RM, expression, shimmering sweat ,up-close view, studio environment ,dramatic pose,photorealistic,8K,HDR-10,rendered based on 8th physics

두 프롬프트를 비교해보면, 2번 프롬프트가 1번보다 훨씬 노골적이며 민감한 표현을 다수 포함하고 있음에도 불구하고, 실제 SeaArt 플랫폼에서는 1번 프롬프트가 차단되고 2번은 정상 된 사례가 확인되었다.

이러한 결과는 필터링 시스템이 수위나 맥락이 아닌, 단순 키워드 기반으로 작동하고 있음을 보여주는 대표적 사례로 평가된다.

결과적으로, 이 불균형은 사용자들로 하여금 검열 기준의 불성과 불공정성을 인식하게 만들며, 플랫폼 전반의 콘텐츠 신뢰도 저하로 이어지고 있다.

3. 원인 분석

(1) AI 필터링 모델의 과적합(Overfitting) 문제

AI 모델이 특정 형태·색상·태그 조합에 과도하게 반응하도록 학습되어, 의도하지 않은 표현까지 제재하는 경향이 있다.

이로 인해 ‘정상적 인체 묘사’와 ‘성적 표현’의 경계가 불명확해지고, 시스템 전체가 보수적 판별 기준으로 편향된다.

(2) 국제 규제 환경의 급격한 변화

2024~2025년 사이, 주요 AI 플랫폼에서 -물·성적 이미지 자동 규제 강화가 잇따라 시행되었다.

SeaArt 역시 이 국제적 흐름에 발맞추어 필터링 정책을 강화했으나, 글로벌 기준을 그대로 적용함으로써 문화·표현의 다양성을 고려하지 못한 채 획일적인 규제가 도입된 것으로 분석된다.

(3) 검열 단어 데이터베이스의 관리 및 동기화 오류

업데이트 과정에서 다국어 검열 리스트가 병합·중복되는 과정에서 키워드 충돌 및 중복 필터링이 발생하였다.

일부 단어는 의미적 맥락을 무시한 채 차단 리스트에 포함되어, 결과적으로 필터의 폭주 현상이 나타났다.

4. 문제점

- 창작 표현의 자유 침해 예술적·서사적 맥락에서의 인체 묘사나 감정 표현조차 검열 대상으로 오인되며, 창작자의 창의성이 위축된다.

- 항소 시스템의 비효율성 및 불신 확대 항소가 승인되더라도 시스템 반영이 지연되어, ‘해제되지 않는 블러’ 문제가 장기간 지속된다. 이는 기술적 신뢰성뿐 아니라 운영 신뢰도에도 부정적 영향을 미친다.

- 성별·태그별 검열 불균형 동일한 수준의 이나 표현임에도 성별에 따라 검열 강도가 달라, 커뮤니티 내 불공정 인식이 확산되고 있다.

- 커뮤니티 참여도 및 콘텐츠 퀄리티 저하 반복되는 오탐지로 인해 이용자들의 창작 의욕이 저하되고, 결과적으로 SeaArt 내 작품의 다양성과 퀄리이 하락하는 경향이 나타난다.

5. 개선 방향 및 제언

(1) AI 필터링 모델의 정밀도 향상

- 예술적·비예술적 콘텐츠를 구분할 수 있도록 다층적 맥락 인식 모델 도입 필요.

- 학습 데이터셋에서 문화적 다양성과 예술적 표현을 충분히 반영해야 함.

(2) 검열 기준의 성 확보

- 검열 단어 리스트와 판정 기준의 일부를 공개하여, 사용자에게 명확한 가이드라인을 제공해야 함.

- 이미 시행 중인 커뮤니티 기반 ‘필터 피드백 루프 시스템’의 운영 효율을 강화하고, 사용자 피드백이 실제 검열 모델 개선에 정기적으로 반영되는 체계적 절차를 구축해야 함.

- 단순 신고 접수에 머무르지 않고, 피드백 → 검증 → 모델 업데이트로 이어지는 순환 구조를 명문화하여 시스템의 성과 신뢰도를 지속적으로 제고할 필요가 있음.

(3) 항소 및 서버 동기화 시스템의 기술적 안정화

- Appeal 결과가 정상으로 반영되도록 서버 캐시 및 검열 상태 동기화 프로세스 개선 필요.

- 블러 해제 후에도 잔류 데이터로 인해 다시 검열되는 현상을 방지해야 함.

(4) 검열 정책의 성별·문화 균형 조정

- 남성·여성 캐릭터 모두에 동일한 판정 기준을 적용하도록 AI 모델의 성별 중립적 인식 개선 필요.

- 단순 량이 아닌 표현의 맥락(Context-based moderation) 중심의 정책으로 전환해야 함.

6. 결론

SeaArt 플랫폼의 검열 강화는 전 세계적으로 진행 중인 AI 콘텐츠 규제 강화의 흐름 속에서 불가피한 조치로 볼 수 있다.

그러나 현재 시스템은 기술적 오탐지, 정책적 불균형, 검열 성 결여 등 복합적인 문제를 안고 있으며, 이는 장기적으로 창작 생태계의 위축과 사용자 신뢰도 저하로 연결 수 있다.

따라서 SeaArt는 다음 세 가지 핵심 방향성을 조속히 실행해다.

- AI 필터링 모델의 고도화와 검증 체계 확립

- 검열 정책의 공개 및 커뮤니티 협력 강화

- 기술적 안정화 및 효율적인 반영 시스템 구축

이러한 개선이 이루어지면, SeaArt는 단순한 콘텐츠 공유 플랫폼을 넘어, AI 예술 창작의 신뢰성과 자율성을 보장하는 글로벌 크리에이티브 허브로 성장할 수 있을 것이다.

내 생각

현재 검열 시스템과 관련하여 가장 큰 문제는 판정 기준의 불명확성과 비일관성입니다. 어떤 콘텐츠는 통과되고, 유-사-한 다른 콘텐츠는 차단되는 상황이 반복되고 있으며, 그 원인에 대해 사용자가 명확히 인지할 수 있는 정보가 전혀 제공되지 않는다는 점이 근본적인 문제로 보입니다.

표현의 자유가 제약된 상황에서 크리에이터들은 불합리한 검열에 대한 상실감과 무력감을 느끼고 있으며, 일부는 이러한 불한 제재에 대해 극단적인 불만을 표출하기도 합니다. 이는 단순한 감정적 반응이 아니라, 표현의 자유와 창작의 권리를 보호받지 못하는 환경에 대한 구조적 불신의 결과입니다.

물론, 플랫폼이 기업으로서 일정 수준의 규제를 시행하는 것은 이해할 수 있습니다. 법적·윤리적 책임을 다하기 위한 불가피한 조치임을 인정합니다. 그러나 동시에, 크리에이터가 스스로 무엇이 문제였는지를 파악하고 개선할 수 있도록 돕는 체계는 반드시 필요합니다.

따라서, 검열 및 제재가 이루어진 경우 그 이유를 일러스트, 비디오, 게시물의 텍스트 및 태그 등 각 항목별로 구체적으로 확인할 수 있는 피드백 인터페이스 또는 한 검열 결과 시스템을 구축해야 합니다.

이러한 체계는 단순히 크리에이터의 불만을 해소하는 수준을 넘어, 플랫폼 전반의 신뢰성 강화 및 건전한 창작 생태계 조성에 기여할 것입니다.