初回投稿日:2025年 4月 19日

~はじめに~

こんにちは。

今回は ComfyUI について紹介してみたいと思います‼

いつか執筆しようと思いながら手を付けられていませんでしたが、今回イベントが公表されましたのでこの機会に...

まず、みなさん ComfyUIはご存じでしょうか?

既に使用されているユーザーの方は、おそらく私よりも熟知されていると思います。というか、私自身が初心者です(笑)

一応、公式からもユーザーガイドが公開されていますし、ときどきイベントのテーマや条件になったこともありますが、毎回応募数も振るわないようです。一般的な SeaArtユーザーにとっては、「なにそれ?」「こんな複雑そうなツール使う気にならない」「別に普通に画像や動画が生成できるから問題無いし…」といった印象のほうが多いと思います。

という私も、一見複雑で難解な図形のような組み合わせから距離を置いていましたが、最近少しだけ挑戦してみた経験をもとに紹介させていただきたいと思います。

※あくまで私の主観的な解釈によるものですので、その点をご理解のうえ参考にしてください。

<ComfyUIとは?>

一般的にAI生成利用者に通用する用語で例えるならば、Stable Diffusion の多機能版といったところでしょうか…?

根本的には全く異なるのですが、実はローカル環境でも動作するシステムで、画像生成に限らず動画の生成や加工なども行うことができます。

<ComfyUIを紹介する理由>

実際、ComfyUI を使うことができなくてもWEBサービスを利用することで簡単に画像や動画を生成できるようになりましたが、ComfyUI は統一されたインターフェース(操作画面)で使用することができ、【ノード】と呼ばれる機能(後述を参照)を使用することで、特殊加工を行うことができるため、よりクリエイティブな作品生成する補助をしてくれるツールとしての可能性を感じています。

しかし、一見複雑そうな表示と、ユーザーガイドを見ても、よく分かりません! と、私自身も感じていたため、同じような印象を持たれているユーザーの方が興味を持てるような紹介はできないものかと、今回、記事の執筆に挑戦することにしました。

私自身もまだまだ分からないことばかりですが、ComfyUI の学習方法としてお読みいただけると良いかと思います。

基本ワークフローからの編集を推奨される提案もありますが、私としては、まずはまっさらな状態から初めて一度基本のワークフローを1から作成されることを推奨します。

プログラミングと比較して、視覚化された機能を利用してツールを組み上げていくことができますので、せめて少しでも興味を持てるきっかけをご提供できたら幸いです。

前置きが長くなりましたので、そろそろ本題に入っていきたいと思います。

<用語の解説>

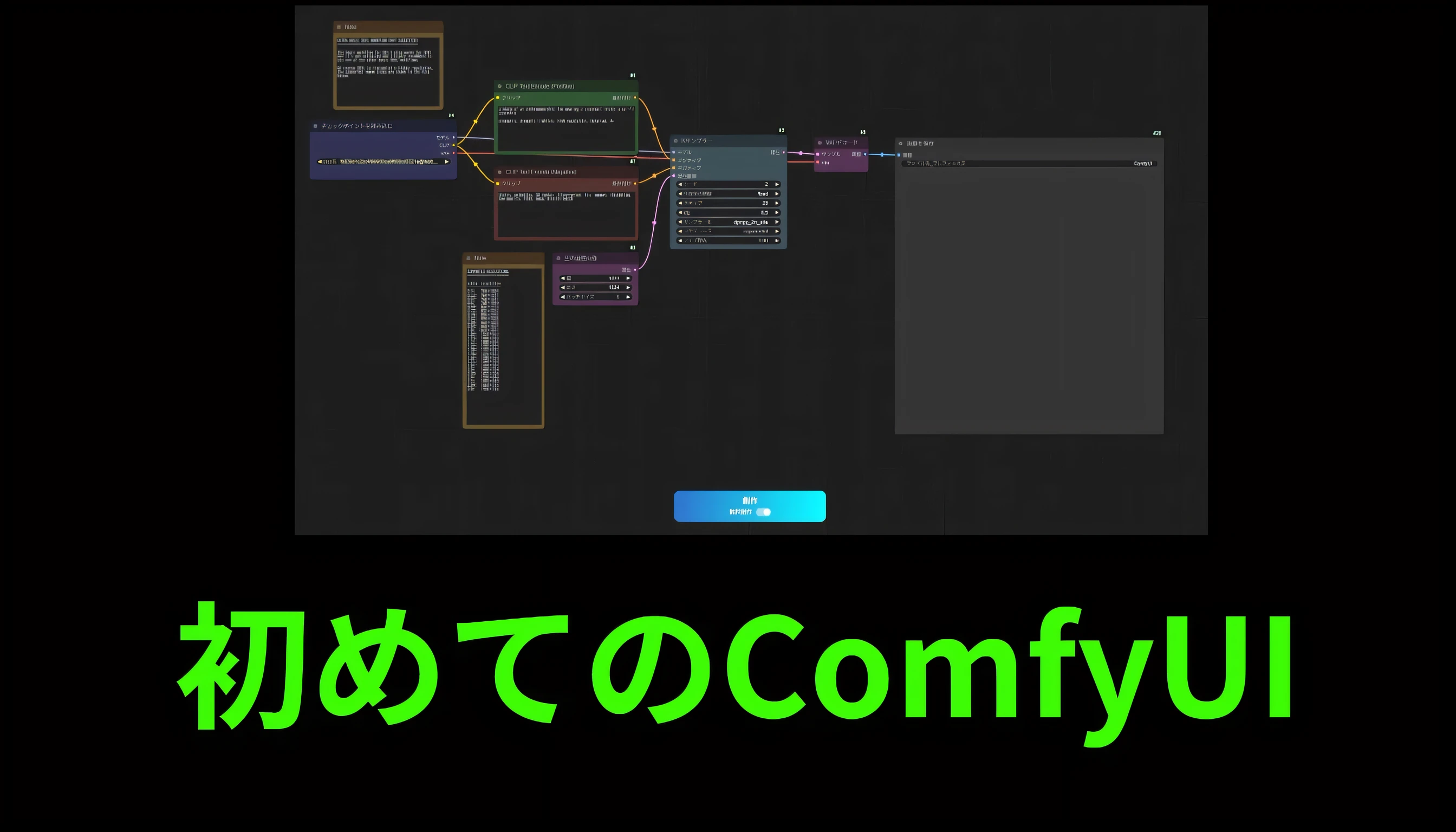

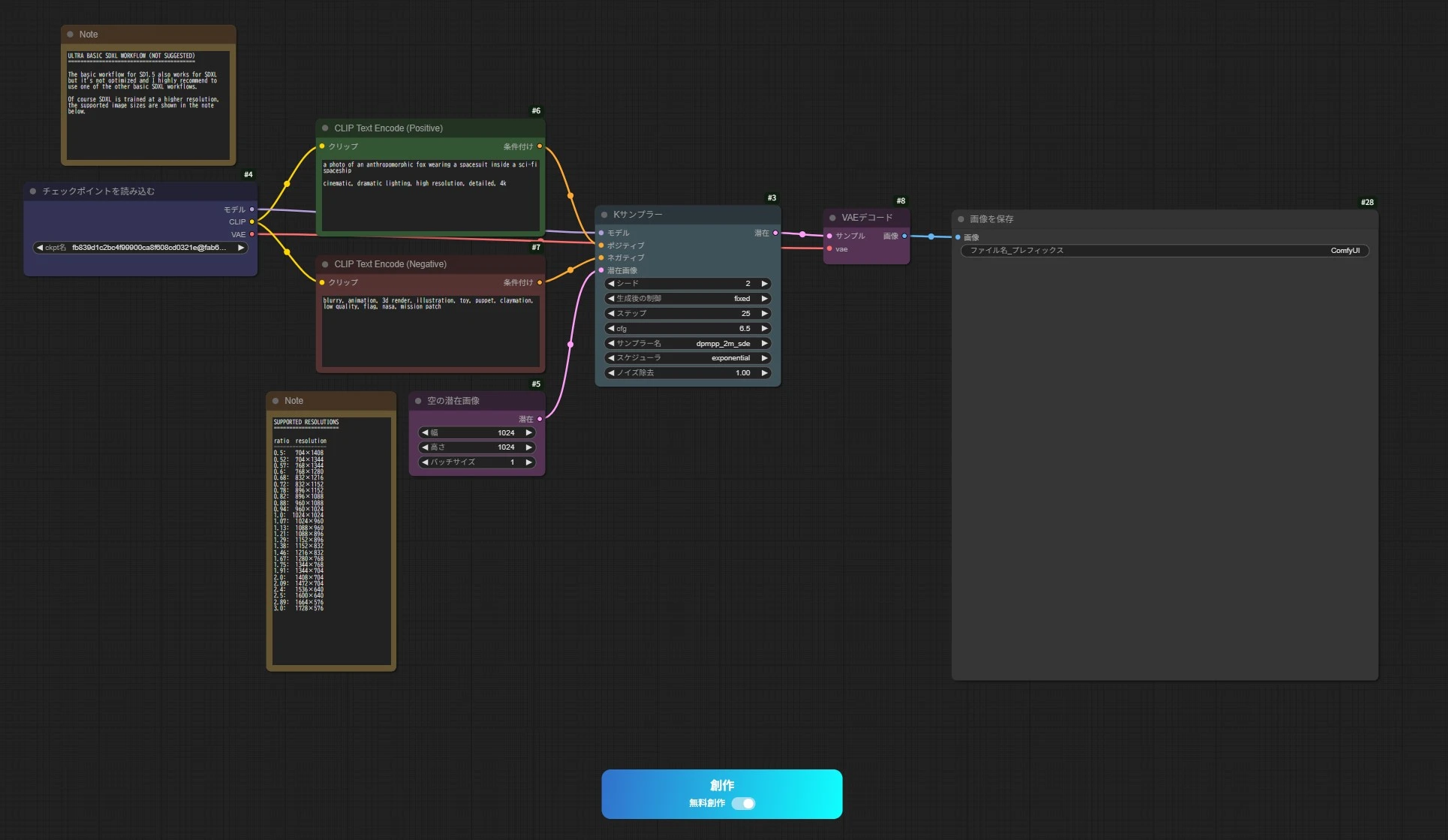

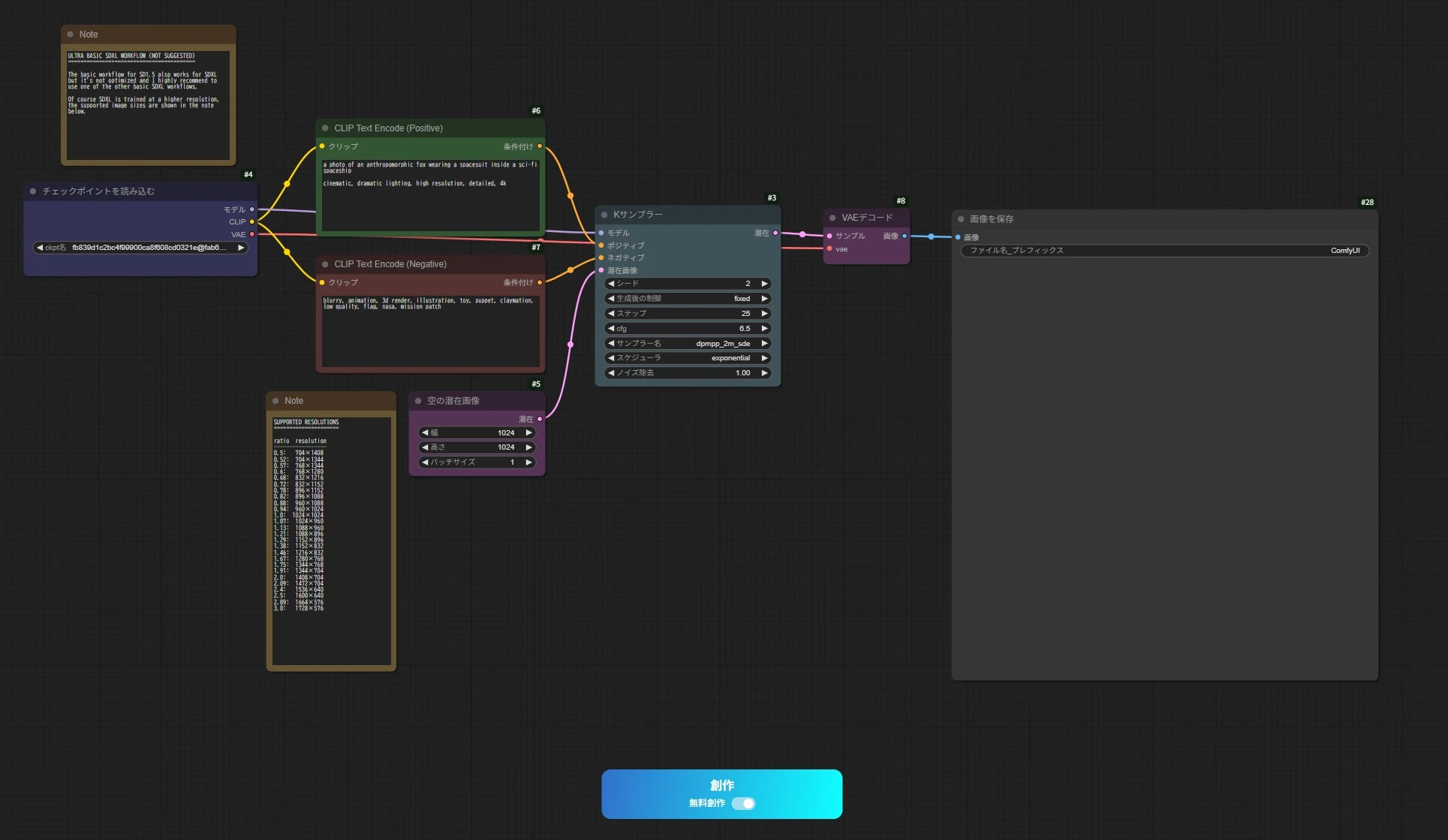

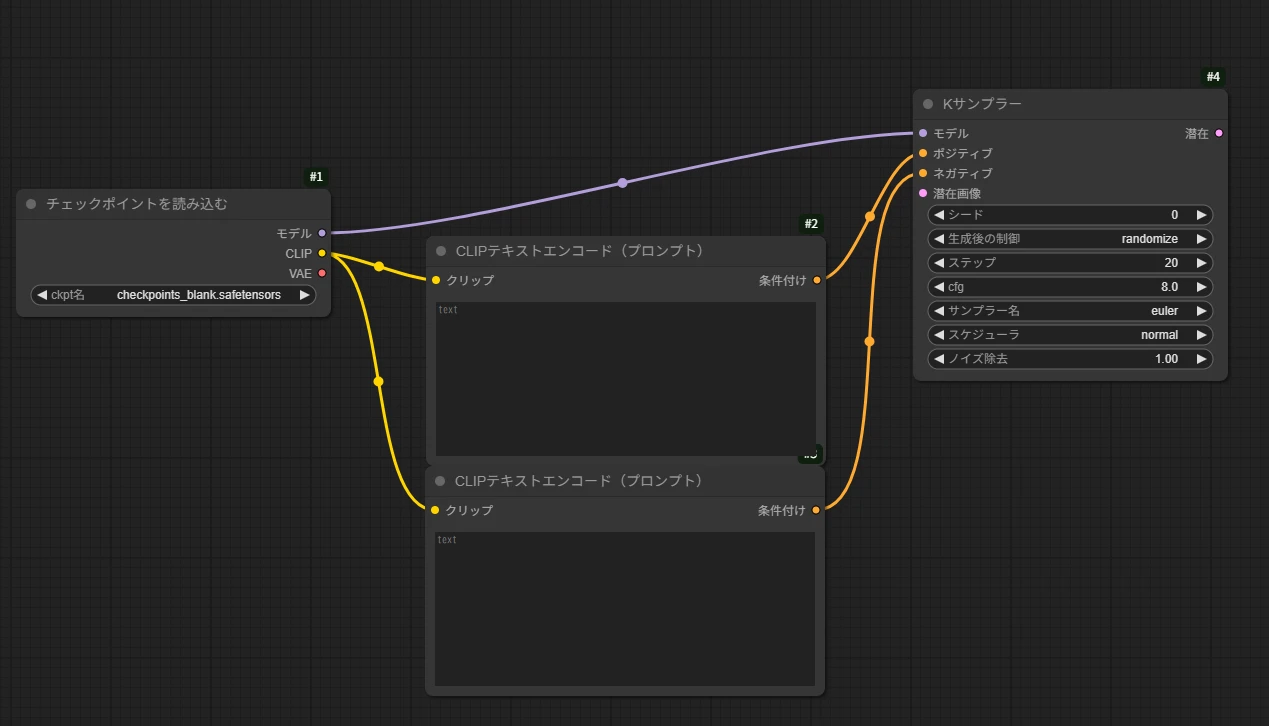

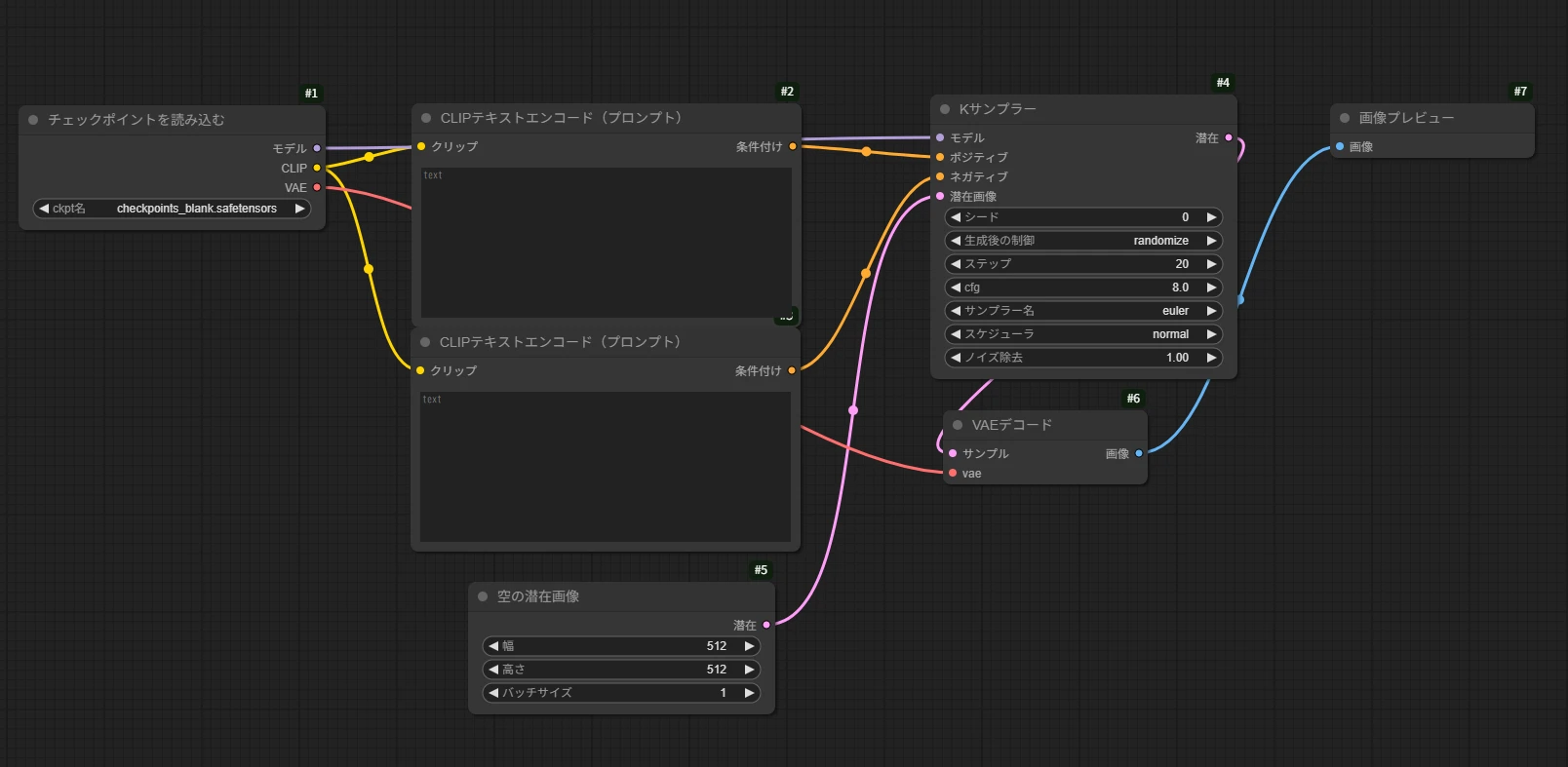

まず、下図のような構築された纏まりは【ワークフロー】と呼ばれます。

(公式の推奨テンプレート/基本SDXLワークフローからの引用)

そして、線で繋がれたこれらのパーツは【ノード】と呼ばれます。

ComfyUI では、これらの【ノード】を組み合わせて【ワークフロー】を完成させることで、ツールとして使用することができるようになります。

<基本的な考え方>

多くのユーザーガイドでは下図のようなワークフローから解説されているのですが、私は少し違った視点から説明させていただきます。

一般的な画像生成の手順を大まかに整理すると、

① CheckPoint モデルの選択

②プロンプトの入力

➂パラメーターの調整

④出力サイズの決定

⑤出力データを画像に変換

⑥生成結果の表示(保存)

となります。

選択や指定をする順番などはそれぞれ異なると思いますが、ComfyUI の使用法を説明するうえで分かりやすい順に並べてあります。

これらの機能を【ノード】というものに置き換えて、【ワークフロー】と呼ばれる生成システムを組み上げるというのが ComfyUI の考え方です。

<実践トレーニング:チュートリアル>

それでは早速、実際に【ワークフロー】を完成させて見ましょう。

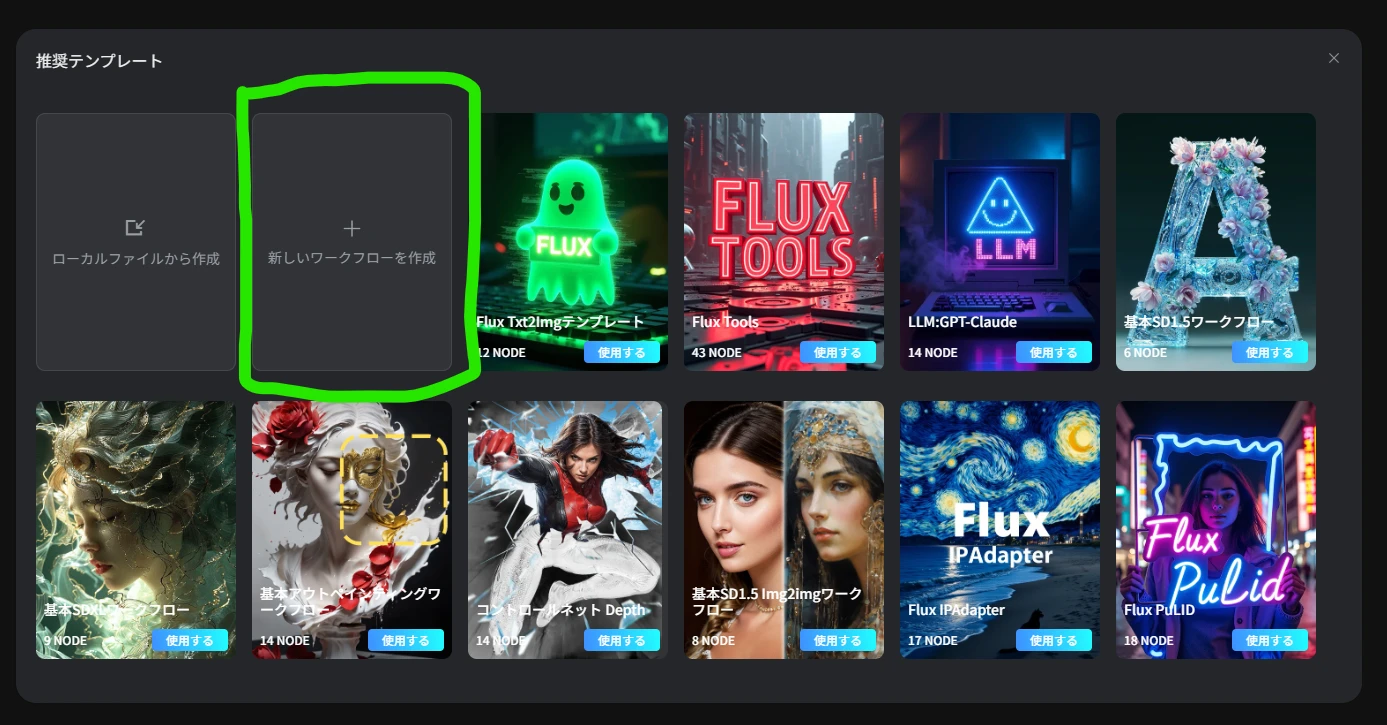

まずは、【ワークフロー】の生成画面を開きます。

SeaArtでは、【作成】⇒ 【ComfyUIワークフロー】 ⇒ 【作成】の順で画面を表示することができます。(下図参照)

今回は、初めての方でも思い切って【新しいワークフローを作成】を選択してください。

⇒

⇒

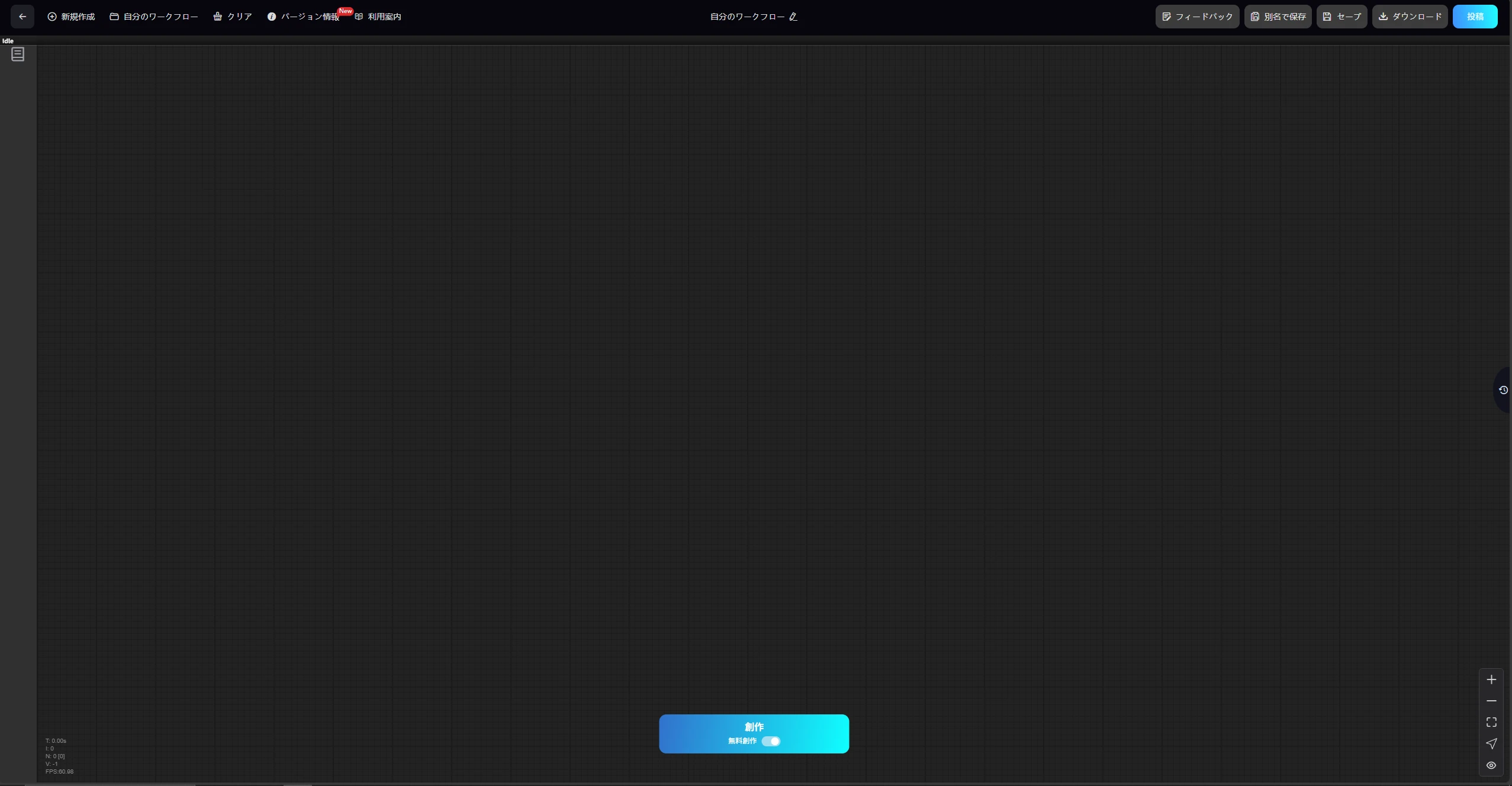

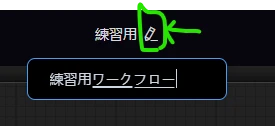

すると、次のような画面が表示されます。必要に応じて、ペンマークを選択して名称を変更します。(変更後は再度ペンマークを選択すると表示が固定されます) もちろんそのままでもOKですし、保存後の変更もできます。

⇒

⇒

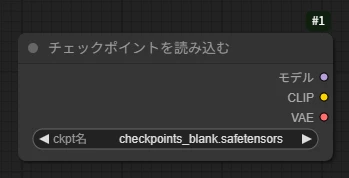

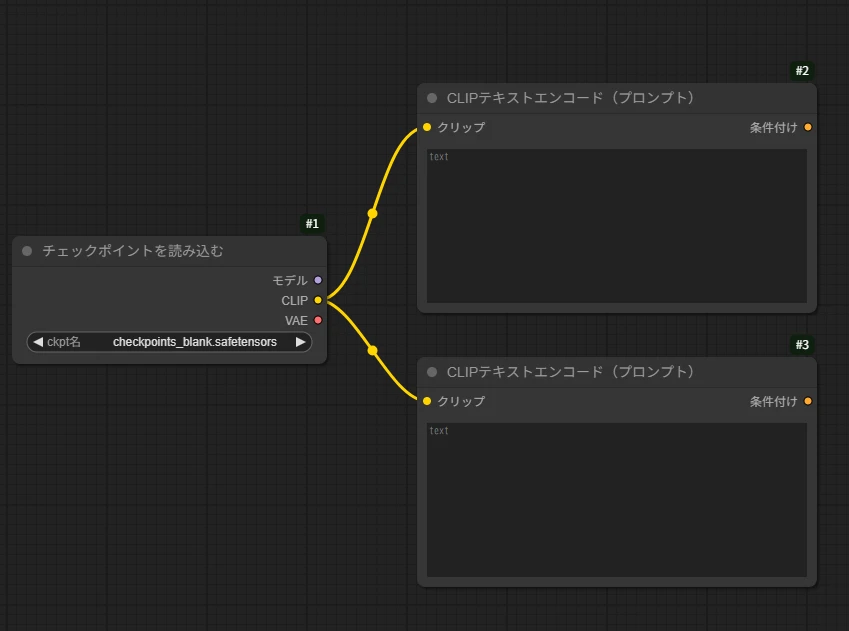

① CheckPoint モデルの選択

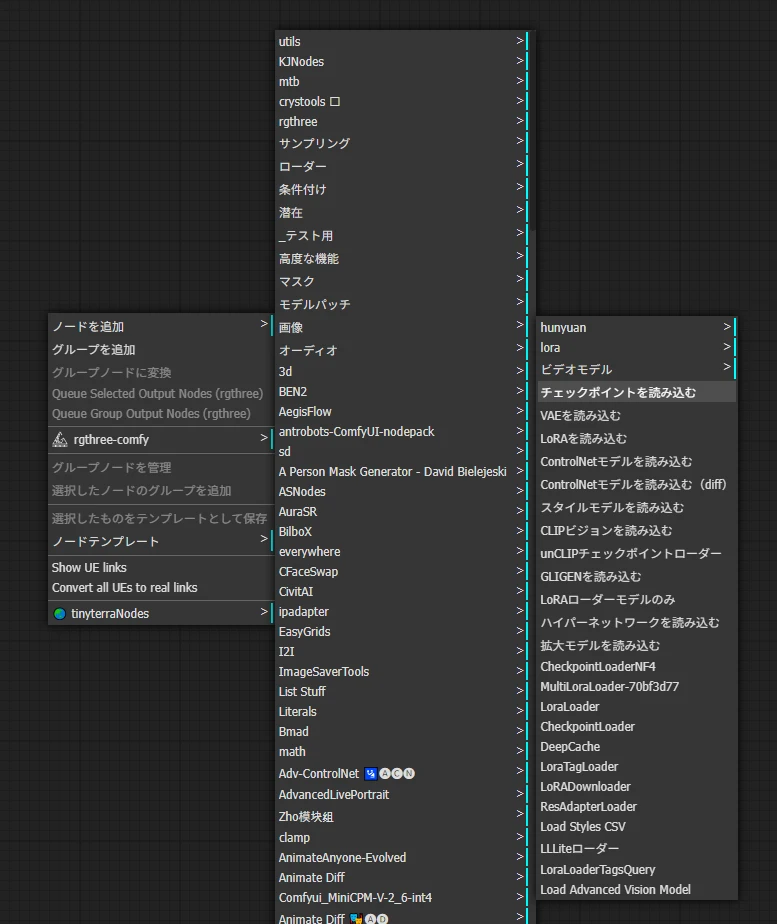

それでは早速チェックポイントモデルを選択する【ノード】を配置します。画面上で右クリックをすると【ノード】選択画面が表示されますので、

【ノードを追加】⇒【ローダー】⇒【チェックポイントを読み込む】の順に選択していきます。(下図参照)

⇒

⇒

《参考》

【ローダー】の項目は主にモデル等の呼び出しに関する【ノード】が振り分けられています。

LoRAモデルの呼び出しなどもこの項目から選択できます。

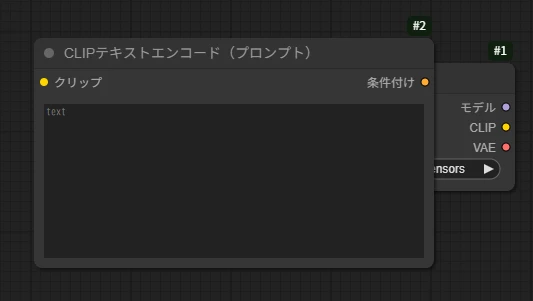

②プロンプトの入力

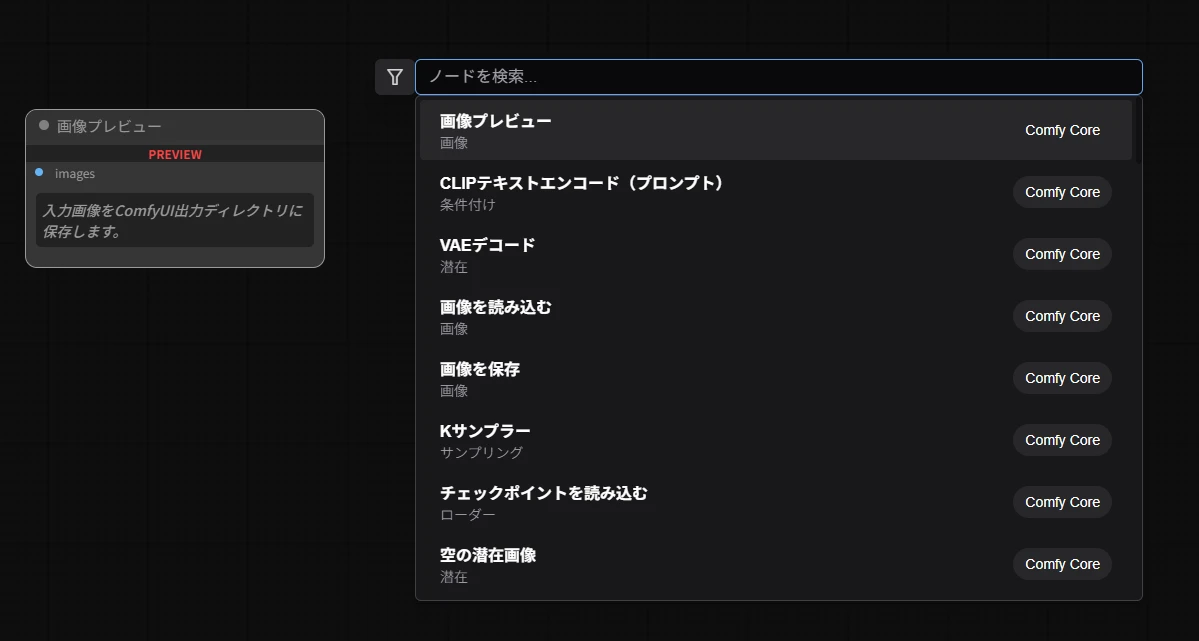

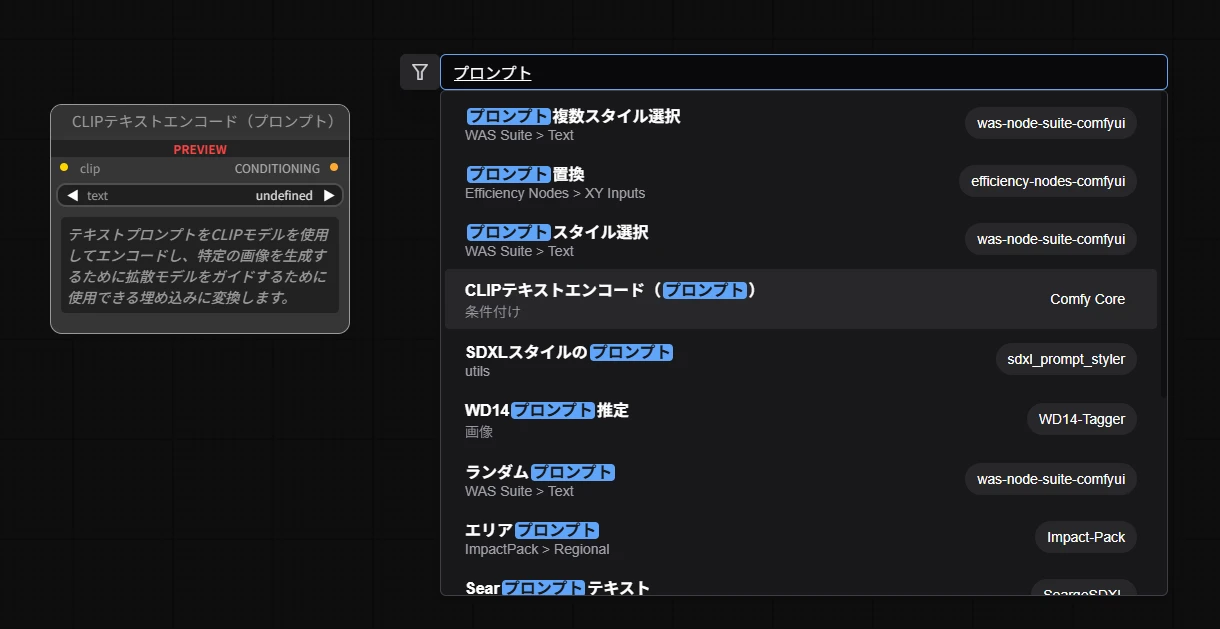

次に、プロンプト入力用の【ノード】を追加しますが、今度は違う方法で呼び出してみます。

画面上でダブルクリックをすると下図のような画面が表示されると思います。

実はすでに使用するノードが表示されているのですが、今回は練習ですので検索窓に「プロンプト」と入力して見てください。すると検索窓の下に「プロンプト」に関連する【ノード】だけが表示されるようになります。

ここで注意する点は、「Enter」キーを押さないということです。 押した時点で(最上部に表示された?)【ノード】の選択が確定されて、読み込まれてしまいます。

検索窓に入力した状態で、オンマウス(クリック操作はしない)をしながら見ていくと、左側に該当する【ノード】が表示されます。

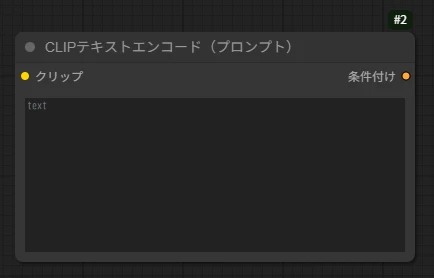

下部に表示された【CLIPテキストエンコード(プロンプト)】を選択して呼び出します。

これが、プロンプトを入力するための【ノード】になります。

⇒

⇒

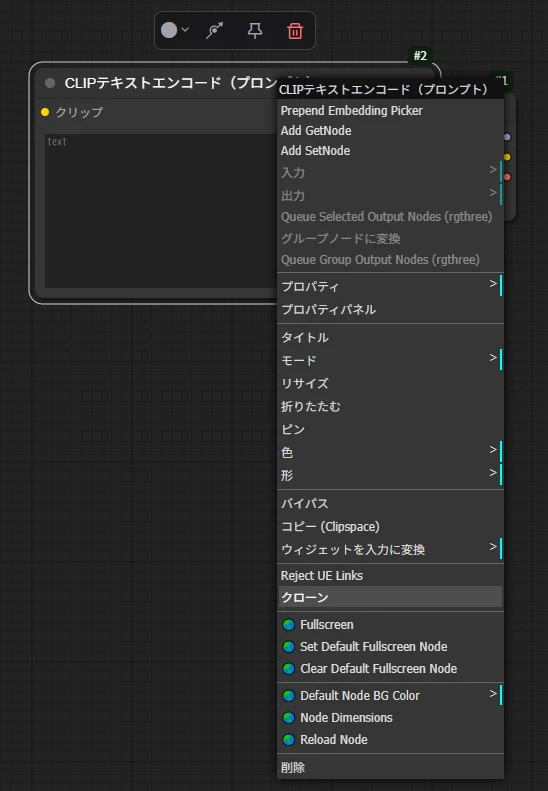

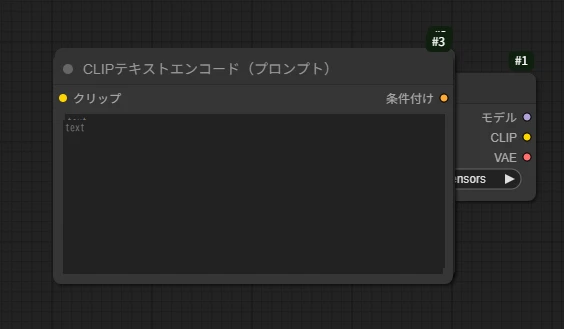

この【ノード】は(ポジティブ)(ネガティブ)の両方で使用するので、複製しておきましょう。

ノードの上で(右クリック)→【クローン】を選択することで複製できます。

⇒

⇒

このままでは重なっていて分かりにくいので、(ドラッグ&ドロップ)操作で見やすい配置に修正します。

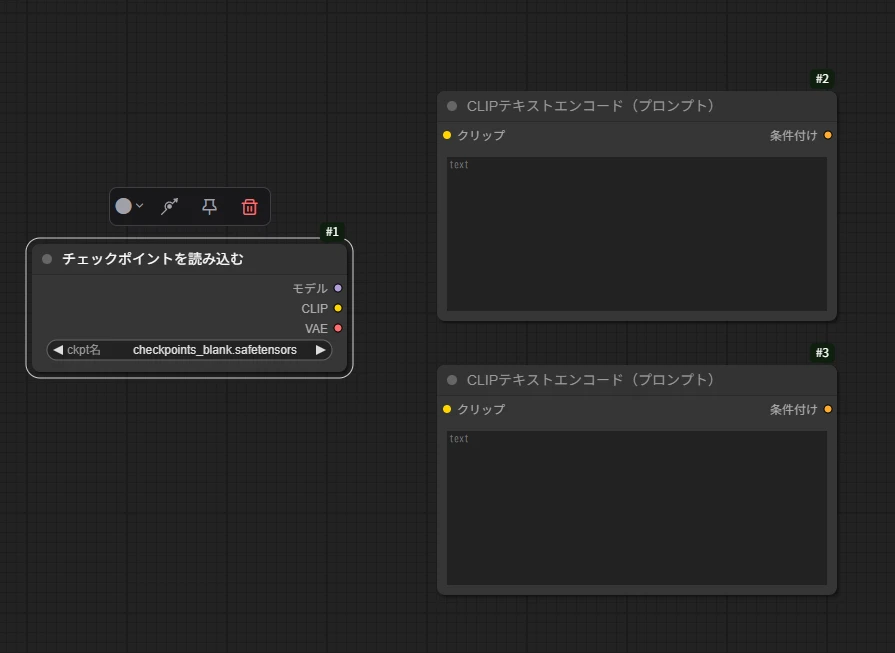

ここで一度、呼び出した【ノード】を接続してみましょう。(最後に接続しても問題ありませんが、今回は説明上その都度接続していきます。)

【CLIP】と【クリップ】を(ドラッグ&ドロップ)操作することで、線で結ばれます。

【CLIP】とは、プロンプトを解釈してモデルの出力に指示を与えるような役割を果たします。

⇒

⇒

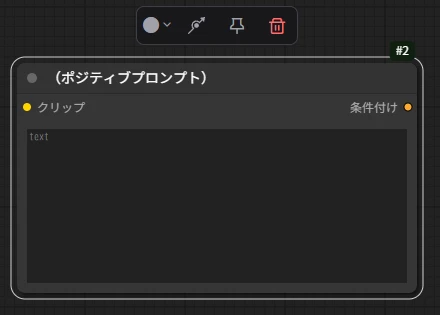

同じ【ノード】の違いを分かりやすくするために、名称を(ダブルクリックすることで)変更しておくこともできます。

⇒

⇒

《参考》

通常の生成ではモデルに内蔵された【CLIP】を使用しますが、異なる【CLIP】を使用することで違った生成結果を得ることも可能です。

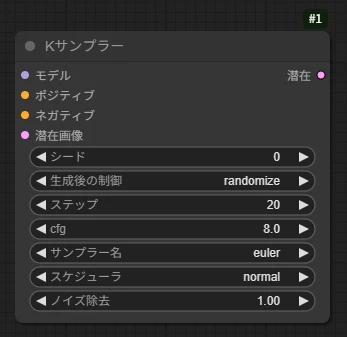

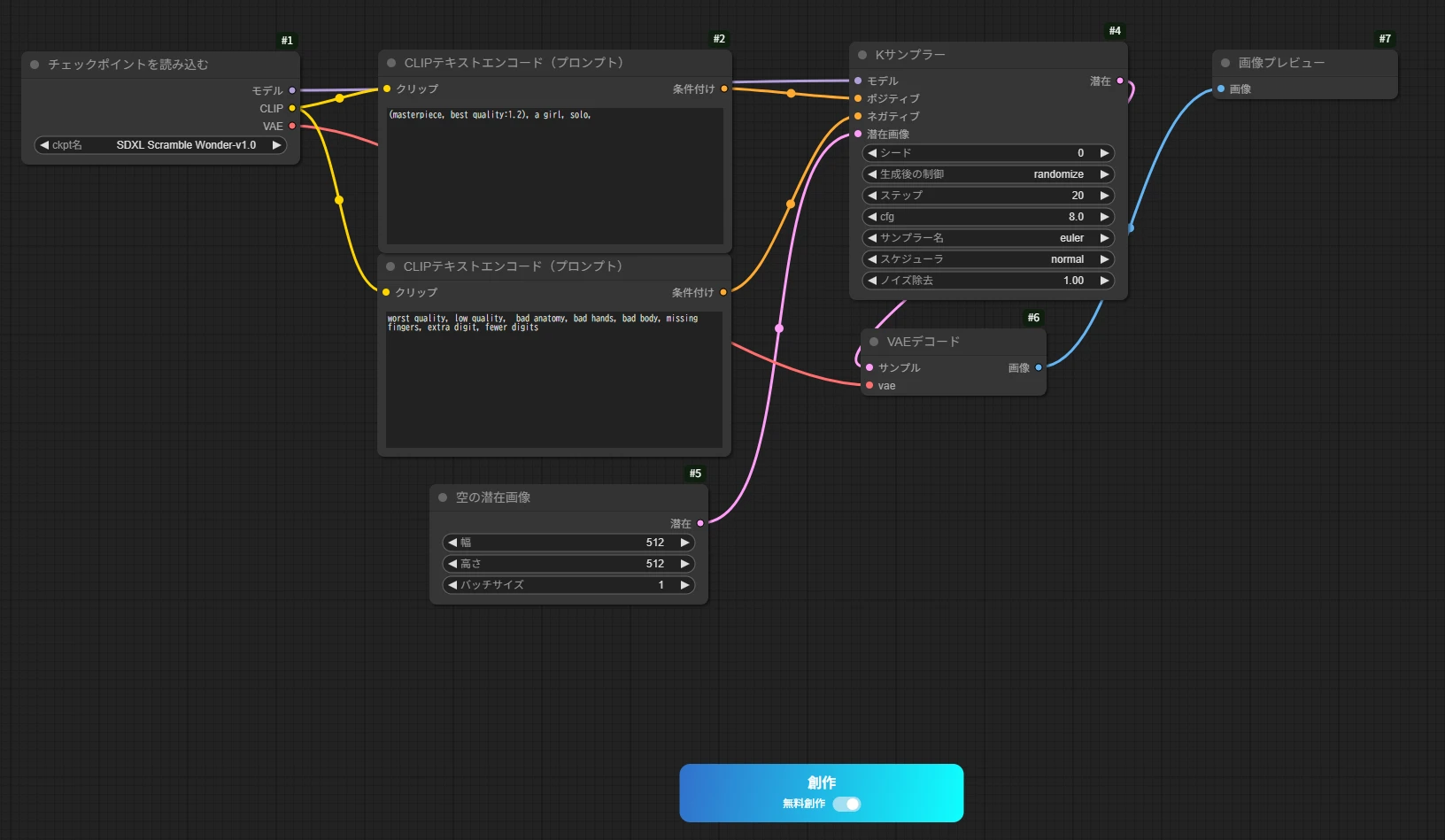

➂パラメーターの調整

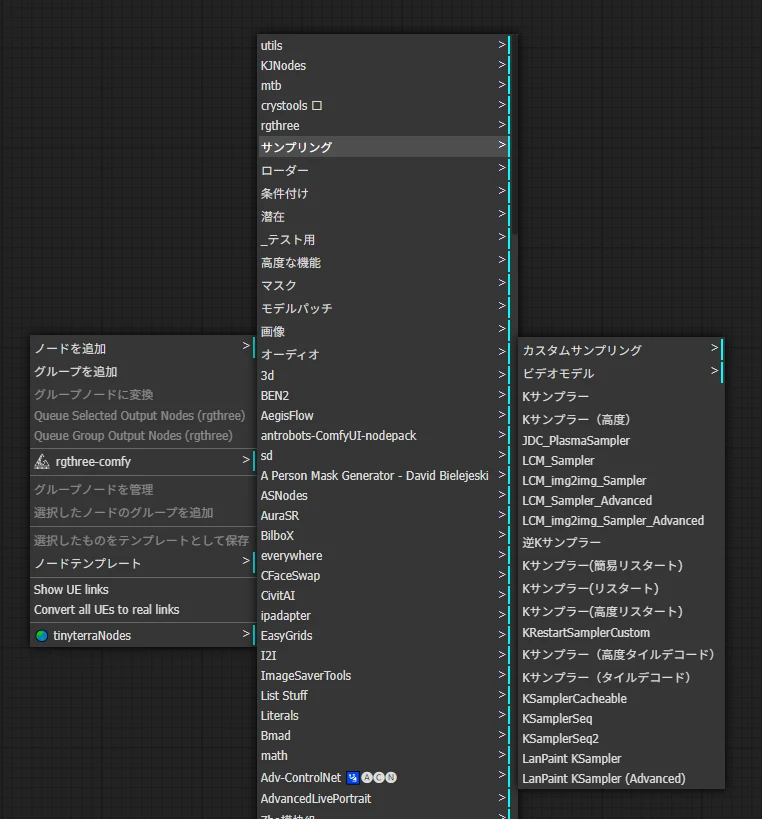

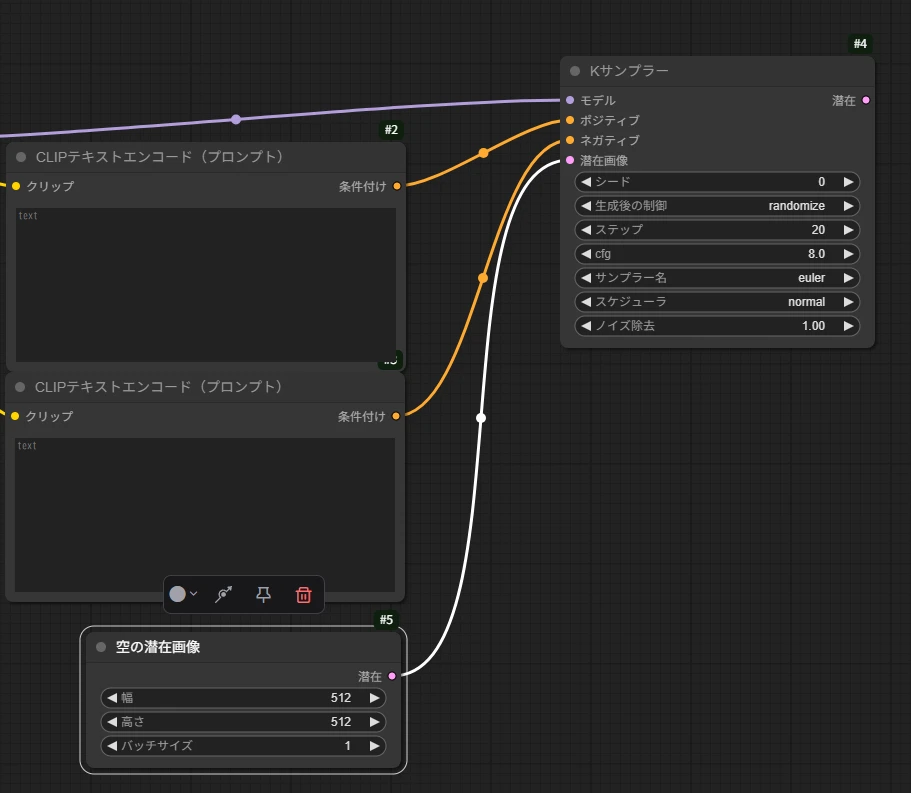

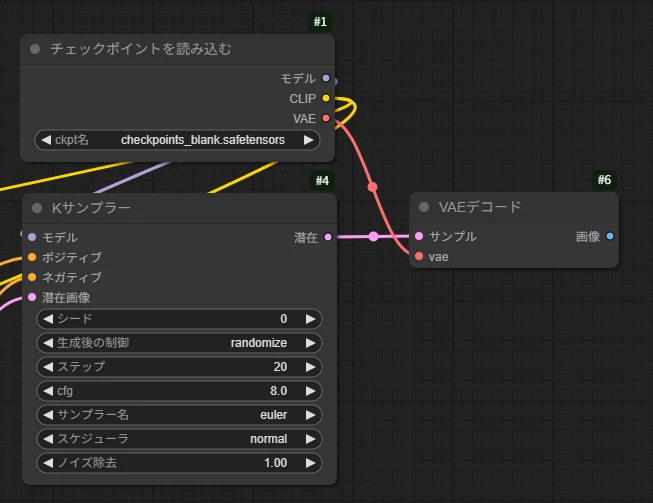

次に【Kサンプラー】と呼ばれる【ノード】を追加します。

【ノードを追加】⇒【サンプリング】⇒【Kサンプラー】の順に選択していきます。(下図参照)

この【ノード】はサンプリング方法を変更、調整することができ、【Kサンプラー(高度)】を使用すると、より詳細な設定が可能になります。

【ノード】の左側に表示された要素を画像データとして統合します。

⇒

⇒

先ほどと同じように【ノード】を接続します。

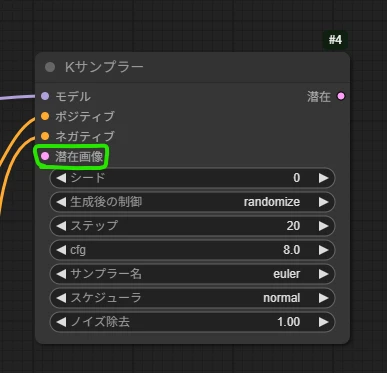

【潜在画像】という部分になにも接続されていない状態になっていますね。

必ずしもすべての点に【ノード】が接続されている必要は無いのですが、この部分には必要な【ノード】が接続されていないとエラーとなりますので、次の手順で必要な【ノード】を呼び出します。

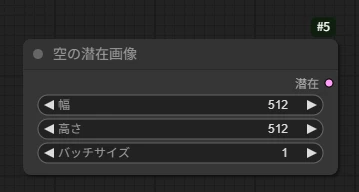

④出力サイズの決定

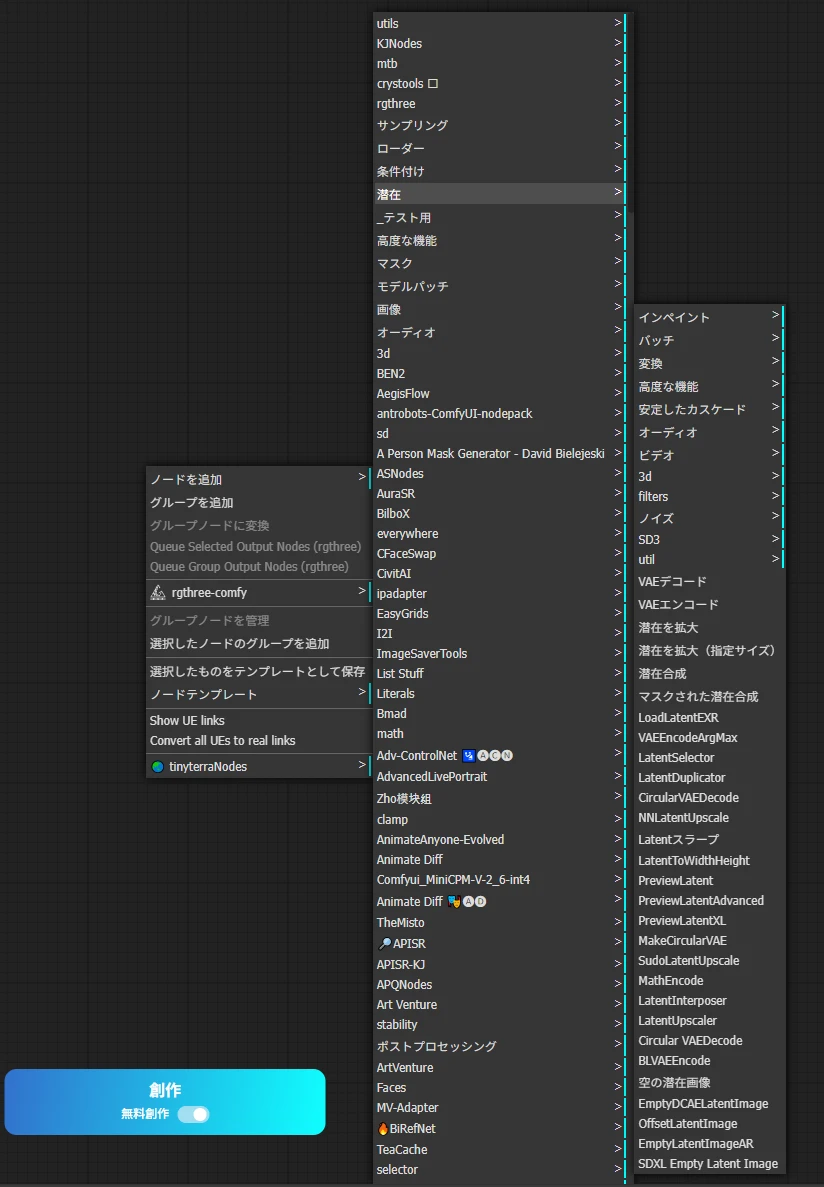

出力サイズを定義するために【空の潜在画像】を追加します。

【ノードを追加】⇒【潜在】⇒【空の潜在画像】の順に選択していきます。(下図参照)

⇒

⇒

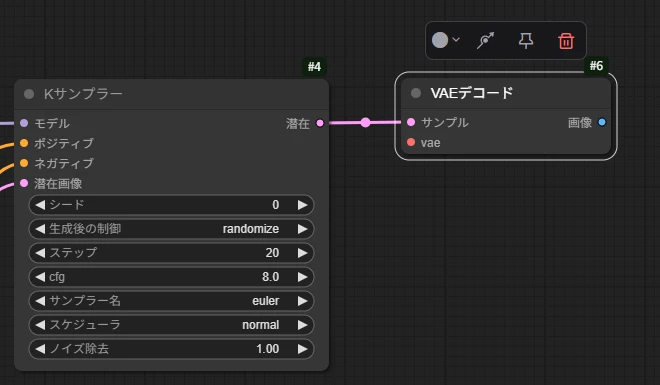

これを先ほどの【Kサンプラー】に接続します。

《参考》

【空の潜在画像】という表記の通り、データの含まれた潜在画像を接続すると、混合された画像が出力されるのだと思います。

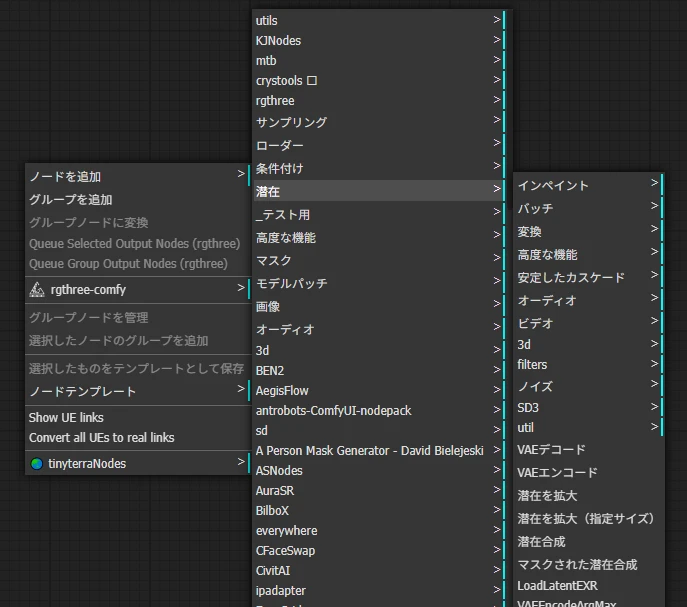

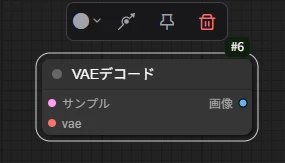

⑤出力データを画像に変換

【潜在】というのはモデルデータとプロンプトの情報が合わせられたもので、このままでは視覚できる状態になっていません。そこで可視化できる画像に変換するために【VAEデコード】を使用して、画像として出力できるデータに変換します。

【ノードを追加】⇒【潜在】⇒【VAEデコード】の順に選択していきます。(下図参照)

⇒

⇒

【VAEデコード】の【VAE】の部分には【チェックポイントモデルを読み込む】の【VAE】を接続しておきます。

【VAE】とは、絵の具のような存在で、色褪せた画像が出力されたりする場合はこの部分が上手く機能していなかったりする場合が考えられます。

SD1.5系では、モデルデータの容量から【VAE】が内蔵されていないのが一般的で、SDXL系以降にモデルに内蔵されるのが標準になったらしいです。

⇒

⇒

《参考》

【VAE】も【CLIP】同様、モデル内蔵データとは異なる【VAE】を使用することで違った生成結果を得ることも可能です。

⑥生成結果の表示(保存)

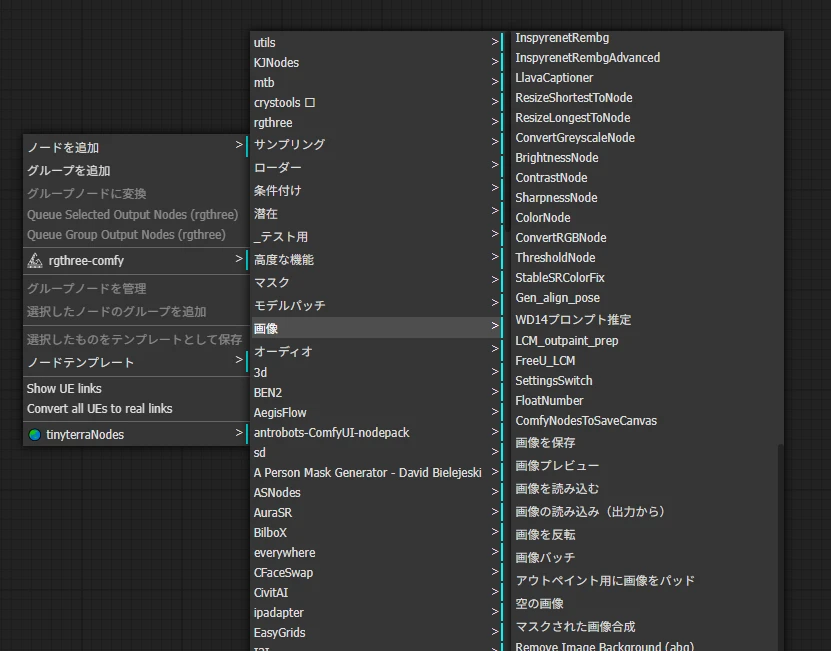

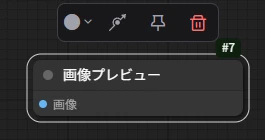

最後に、生成された画像を表示させるための【ノード】を追加します。

【ノードを追加】⇒【画像】⇒【画像プレビュー】の順に選択していきます。(下図参照)

《参考》

【画像プレビュー】は画像を表示するだけですので、保存する場合には手動での操作が必要です。

【画像を保存】の【ノード】を使用すると生成後に自動で画像が保存されます。

⇒

⇒

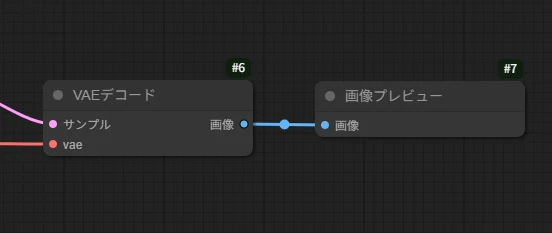

【VAEデコード】と【画像プレビュー】を接続します。

これで基本的な【ワークフロー】が完成しました。

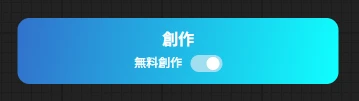

各選択項目を設定・調整してプロンプトを入力

【創作】を開始すると、画像が生成されます。

⇒

⇒

<応用編:ノードの紹介>

ここでは、参考にいくつかの【ノード】を紹介させていただきます。

接続ポイントを変更したり、類似の【ノード】を試してみたり… と、実際に自分で操作することがもっとも学習に効果的だと思いますので、ぜひ、ご自身で試してみてください♪

私も初心者ですので、難しい【ノード】や調整はわかりません‼ が、それなりに楽しめるようになってきました。(笑)

もし、この記事をきっかけに少しでも興味を持っていただけたのであれば、皆様も ComfyUI に挑戦してみてはどうでしょうか?

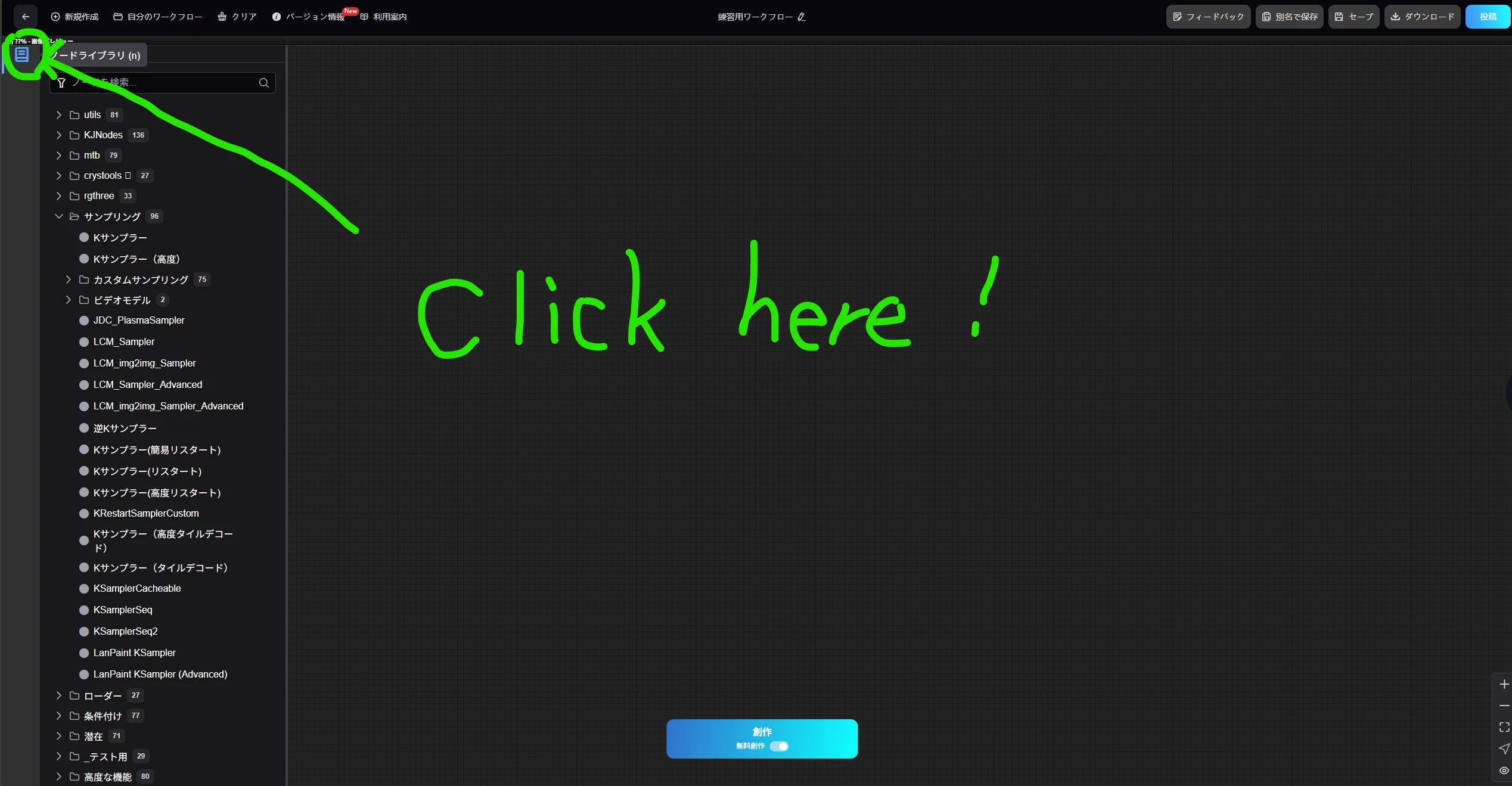

《参考》

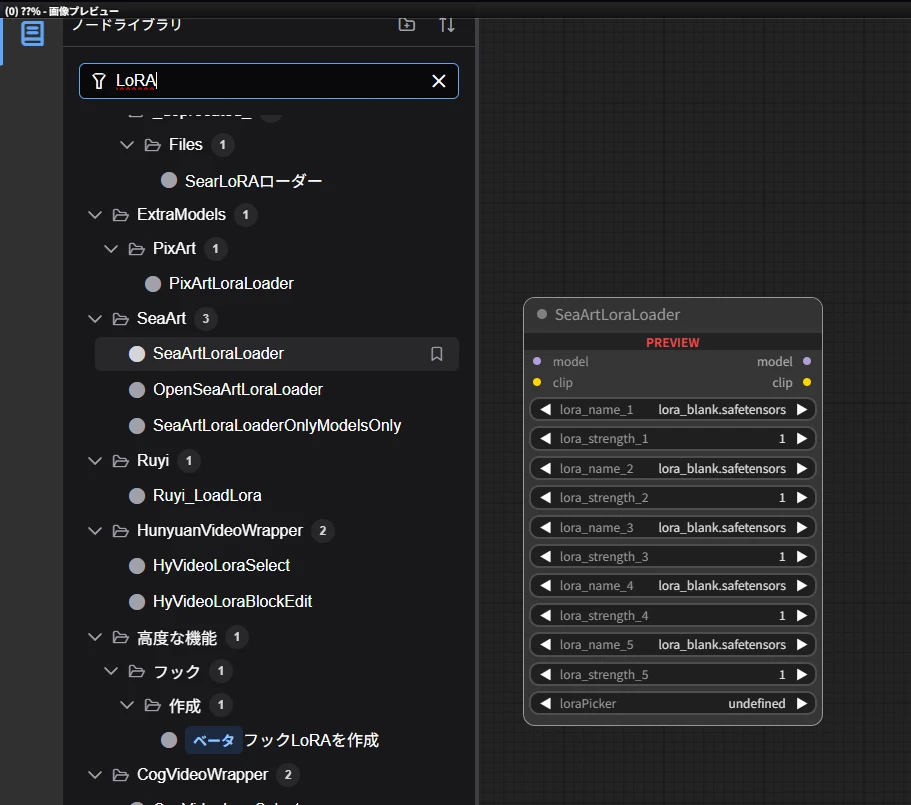

SeaArt上でComfyUI を使用する場合、左上に表示されたノードライブラリから【ノード】検索することも可能です。

こちらの検索の特徴は、分類も表示された状態でオンマウスにより、ノードが確認できます。

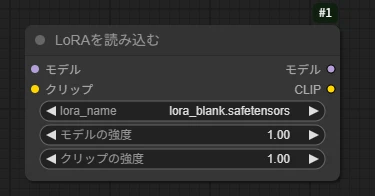

《LoRA関連ノード》

いくつか種類がありますが、LoRAを使用する際にモデルとサンプラーの間に接続します。

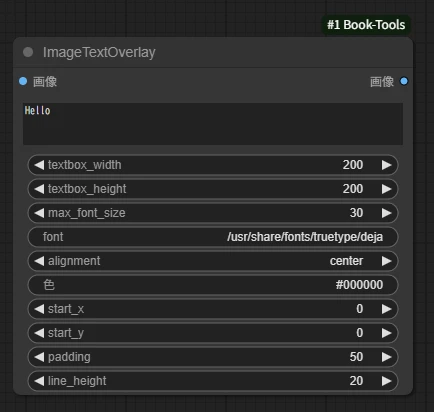

《text関連ノード》

いくつか種類がありますが、テキストを画像に追加します。

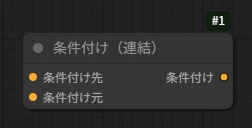

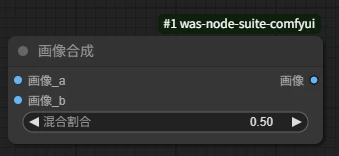

《結合・合成関連ノード》

いくつか種類がありますが、データや画像を結合接続します。

このように、いろいろな機能の【ノード】が存在しますので、もし興味を持たれましたら一度遊んでみてはいかがでしょうか?

~編集後記~

最後までお読みいただきありがとうございます。

この記事は、記事ライター募集イベント応募用に執筆しました。

この記事はいつか執筆したいと思っていたのですが、イベントを機にようやく執筆する気になれました。

正直、このボリュームは疲れました。(笑)

定期的な執筆は正直難しいのですが、私の記事は、熟練者が執筆すると難しい内容を初心者の方にも分かりやすくお伝えできたらという思いで公開しております。もし、この記事をお読みいただいて、「参考になったよ~」とか、「この辺が分かりにくいんだけど…」、「〇〇についても記事にして欲しい」等のご意見がありましたら、コメント欄に記載いただけると嬉しく思います。

頂いた要望について、必ずしも返答できる保証はありませんが、善処します(気持ちだけは…w)

とはいえ、特に新しく画像生成を始められた方も同じようにAI生成を楽しんでいただきたいという思いがありますので、何かありましたら遠慮なくご意見ください m(_ _)m

ちなみに…

※ ↓ 下記のリンクから私の他の記事も閲覧可能ですので、ご興味がありましたらぜひご覧ください。

👉【著者のメイン記事へ】

👉【ビデオノードを用いた基礎学習】

~編集履歴~

Posted on April 19, 2025 / 初回投稿:2025年4月19日

Posted on Jan 10, 2026 / リンクページ追加:2026年1月10日